Si pensabas que el lanzamiento de la NVIDIA H100 en 2023 fue el pico de la locura por el hardware, bienvenido a finales de 2025. El panorama ha cambiado radicalmente. Ya no estamos solo escalando potencia bruta; estamos buscando la eficiencia desesperadamente y rompiendo la barrera de la memoria.

Mientras la NVIDIA Blackwell B200 ha sido la reina indiscutible del último año, el trono se tambalea. Google ha dado un golpe sobre la mesa con su TPU v7 «Ironwood», un chip diseñado específicamente para la inferencia masiva y eficiente, y AMD no se ha quedado atrás con su serie MI350 (CDNA 4). Además, en el horizonte ya asoma el verdadero monstruo: la arquitectura Rubin de NVIDIA.

Este artículo es la guía definitiva y actualizada sobre el estado del arte del silicio para IA a las puertas de 2026. Olvida lo que sabías sobre la H100; eso es historia antigua.

1. El Nuevo Paradigma de 2025: Eficiencia e Inferencia

Antes de entrar en los chips, hay que entender qué ha cambiado en el mercado.

-

De Entrenamiento a Inferencia: En 2023/24, todo era entrenar modelos (GPT-4, Gemini). En 2025, el coste principal es ejecutar esos modelos (inferencia) para miles de millones de usuarios. Aquí, la fuerza bruta no basta; necesitas eficiencia energética (TDP) y latencia baja.

-

La Barrera de la Energía: Los Data Centers ya no pueden consumir más electricidad. El hardware que gana ahora es el que ofrece más «Tokens por vatio».

-

HBM4: La nueva generación de memoria es el campo de batalla clave para 2026.

2. Google: La Revolución Silenciosa de Trillium y Ironwood

Google ha dejado de jugar a la defensiva. Con su infraestructura «AI Hypercomputer», ha desplegado dos armas letales.

2.1. TPU v6 «Trillium»: El Caballo de Batalla (Disponible)

Lanzada a mediados de 2024 y desplegada masivamente en 2025, Trillium es la 6ª generación.

-

Mejoras: 4.7 veces más rendimiento por chip que la v5e.

-

Objetivo: Es el chip principal para el entrenamiento de los modelos Gemini 1.5 y 2.0. Su capacidad de memoria HBM se duplicó, permitiendo manejar modelos más grandes con menos chips.

2.2. TPU v7 «Ironwood»: El Asesino de la Latencia (Preview 2025/2026)

Aquí es donde las cosas se ponen serias. La TPU v7, conocida bajo el nombre en clave «Ironwood«, marca un cambio de estrategia.

-

Alianza con MediaTek: En un movimiento sorpresivo, Google colaboró con MediaTek para el diseño de partes del chip, buscando optimizar la eficiencia energética y los costes de producción.

-

Enfoque en Inferencia: A diferencia de Trillium (entrenamiento), Ironwood está obsesivamente diseñada para la inferencia. Utiliza una arquitectura optimizada para servir modelos LLM con un consumo energético drásticamente menor que una GPU de NVIDIA.

-

Disponibilidad: Google la está desplegando internamente para YouTube, Search y Gemini API, ofreciendo un coste por token imbatible. No se vende al público, se «alquila» como servicio.

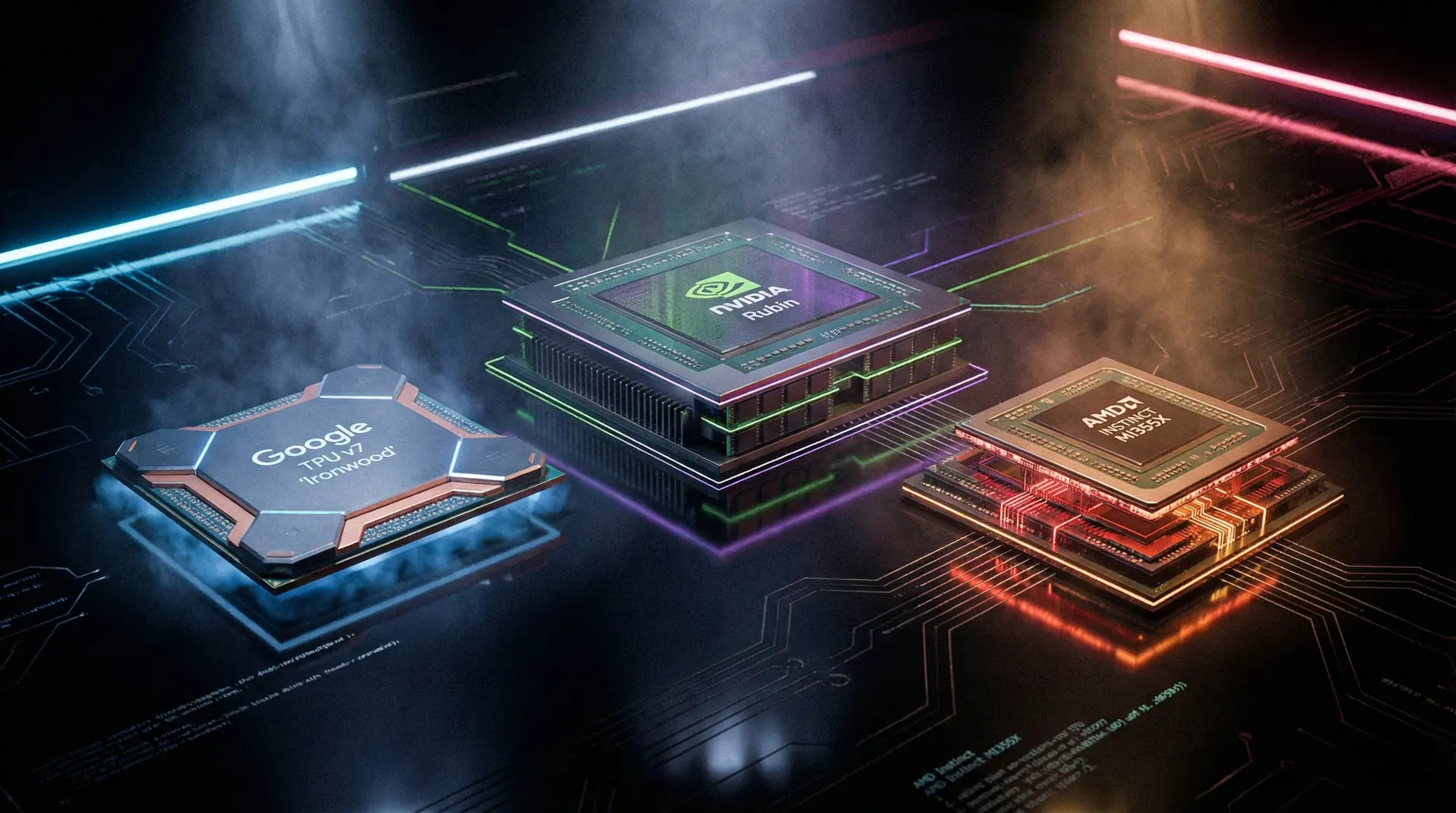

3. NVIDIA: Blackwell Ultra y el Futuro "Rubin"

Jensen Huang no duerme. Sabiendo que sus rivales se acercan, NVIDIA ha acelerado su hoja de ruta a un ritmo anual.

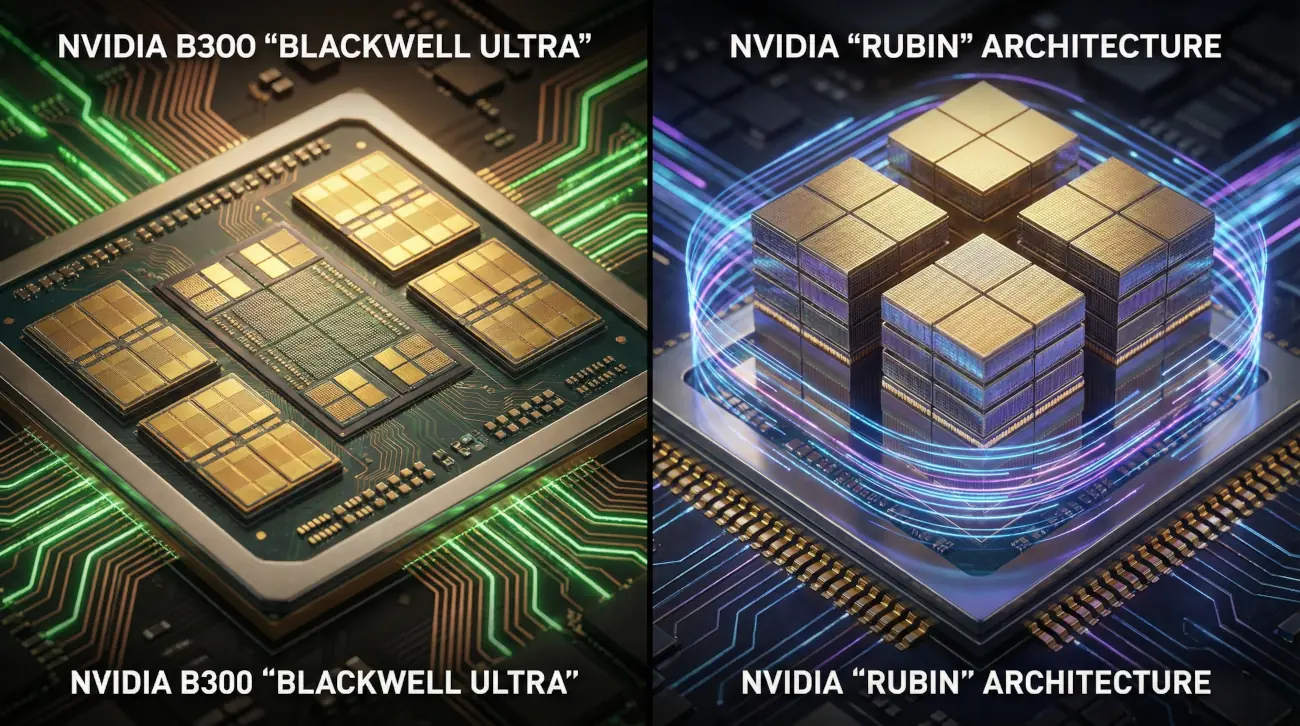

3.1. Blackwell Ultra (B300/GB300)

Para finales de 2025, la B200 original ha evolucionado a la serie Blackwell Ultra.

-

Más Memoria: El foco principal ha sido aumentar la memoria HBM3e para competir con AMD. La serie B300 permite alojar modelos Llama 4 (o equivalentes) en menos GPUs.

-

Dominio del Software: CUDA sigue siendo el rey, pero NVIDIA ahora se enfoca en NIMs (NVIDIA Inference Microservices) para hacer que desplegar modelos en su hardware sea instantáneo.

3.2. Arquitectura «Rubin» (R-Series): La Promesa de 2026

Anunciada oficialmente en sus roadmaps de 2025, Rubin es la sucesora de Blackwell.

-

HBM4: Será la primera GPU de NVIDIA en usar memoria HBM4, lo que supone un salto vertical en ancho de banda, eliminando el cuello de botella actual.

-

CPU Vera: Vendrá acompañada de una nueva CPU «Vera» (sucesora de Grace) para crear superchips aún más integrados.

-

Fecha: Producción en masa prevista para 2026, pero los prototipos ya asustan a la competencia.

4. AMD: El Retador Persistente con CDNA 4

AMD ha demostrado con la MI300X que podía herir a NVIDIA. Con la serie MI350, busca sangre.

4.1. Instinct MI355X (CDNA 4)

Lanzada en la segunda mitad de 2025, la MI355X es la respuesta directa a Blackwell.

-

Arquitectura CDNA 4: Optimizada específicamente para operaciones de baja precisión (FP4/FP6), que son el estándar actual para inferencia de IA.

-

Capacidad de Memoria: AMD sigue liderando en cantidad de VRAM por chip, lo que la hace la opción favorita para empresas que quieren correr modelos gigantescos sin dividir el modelo en demasiadas tarjetas.

-

ROCm 6.5: El software de AMD ha madurado. Ya no es un dolor de cabeza; es una alternativa viable que soporta PyTorch y JAX nativamente.

5. Comparativa Técnica: El Estado del Arte (Finales 2025)

| Característica | NVIDIA B300 (Blackwell Ultra) | AMD MI355X (CDNA 4) | Google TPU v7 (Ironwood) |

|---|---|---|---|

Enfoque Principal | Entrenamiento e Inferencia General | Inferencia de Modelos Gigantes | Inferencia Eficiente y Energética |

Memoria | HBM3e (Ultra Speed) | HBM3e (Ultra Capacity) | HBM Personalizada (Eficiencia) |

Ecosistema | CUDA (Estándar de facto) | ROCm (Abierto y Creciente) | JAX / XLA (Jardín Amurallado) |

Disponibilidad | Muy Limitada (Lista de espera) | Buena | Solo vía Google Cloud |

Punto Fuerte | Rendimiento bruto y ecosistema | Relación Memoria/Precio | Coste por Token y Eficiencia |

6. ¿Quién Gana en 2026?

La respuesta depende de quién seas:

-

Si entrenas Modelos de Frontera (OpenAI, xAI): NVIDIA sigue siendo el rey. Rubin y Blackwell Ultra ofrecen la escala y estabilidad necesaria para clusters de 100.000 GPUs.

-

Si eres una Enterprise sirviendo modelos Llama/Open Source: AMD MI355X es la opción inteligente. Más memoria significa menos GPUs para servir el mismo modelo, reduciendo el TCO.

-

Si vives en la Nube y buscas eficiencia: Google TPU v7. Si tu stack es compatible con JAX/TensorFlow, nadie bate a Google en precio y eficiencia energética dentro de su nube.

💬 Preguntas y Respuestas (FAQ)

1. ¿Es cierto que Google TPU v7 "Ironwood" es más potente que NVIDIA Blackwell?

1. ¿Es cierto que Google TPU v7 "Ironwood" es más potente que NVIDIA Blackwell?

No necesariamente en «fuerza bruta» (FLOPS puros), pero sí puede ser superior en rendimiento por vatio para tareas de inferencia. Google y MediaTek diseñaron Ironwood para ser extremadamente eficiente al servir modelos, lo que significa que para empresas como Google (o usuarios de su nube), ejecutar un modelo en v7 es más barato y consume menos energía que en una Blackwell, aunque la Blackwell pueda entrenar modelos más rápido.

2. ¿Qué es la arquitectura Rubin de NVIDIA y cuándo sale?

2. ¿Qué es la arquitectura Rubin de NVIDIA y cuándo sale?

Rubin es la arquitectura de GPU de próxima generación de NVIDIA, sucesora de Blackwell. Fue anunciada en los roadmaps de 2025. Sus características clave incluyen el uso de memoria HBM4, una nueva CPU acompañante llamada «Vera», y un enfoque en romper los límites de ancho de banda. Se espera su producción en masa para 2026, posicionándose como el motor de la IA para 2026-2027.

3. ¿Qué aporta la memoria HBM4 que mencionas tanto?

3. ¿Qué aporta la memoria HBM4 que mencionas tanto?

HBM4 (High Bandwidth Memory 4) es el próximo gran salto. A diferencia de HBM3e, HBM4 permite un ancho de banda mucho mayor y, crucialmente, permite integrar lógica directamente en la base de la memoria. Esto reduce la latencia y el consumo energético drásticamente. NVIDIA Rubin y las futuras AMD MI400 serán las primeras en aprovecharla.

4. ¿Ha solucionado AMD sus problemas de software con ROCm en 2025?

4. ¿Ha solucionado AMD sus problemas de software con ROCm en 2025?

En gran medida, sí. A finales de 2025, ROCm (versión 6.5 o superior) es estable y soporta nativamente la mayoría de frameworks como PyTorch, TensorFlow y JAX. Hugging Face y otras plataformas ya ofrecen soporte «out-of-the-box» para AMD. Aunque CUDA sigue teniendo herramientas más avanzadas para nichos específicos, para el 95% de los usuarios de IA, ROCm ya no es una barrera bloqueante.

5. ¿Qué es Google Trillium y en qué se diferencia de Ironwood?

5. ¿Qué es Google Trillium y en qué se diferencia de Ironwood?

Trillium es la TPU v6. Es un chip potente y equilibrado, lanzado para manejar tanto entrenamiento masivo como inferencia. Ironwood (v7) es una evolución posterior que parece especializarse más agresivamente en la eficiencia de inferencia y el bajo consumo, utilizando diseños colaborativos (MediaTek) para escalar la producción y reducir costes operativos en los data centers de Google.

6. ¿Por qué se dice que la memoria es más importante que el procesador en 2025?

6. ¿Por qué se dice que la memoria es más importante que el procesador en 2025?

Porque los modelos de IA no han parado de crecer. Un modelo con billones de parámetros necesita terabytes de memoria solo para «existir». Si el chip es muy rápido calculando pero lento leyendo datos de la memoria (ancho de banda), el procesador se queda parado esperando. En 2025, el «Memory Wall» (muro de la memoria) es el principal cuello de botella, por eso AMD y NVIDIA pelean tanto por HBM3e y HBM4.

7. ¿Puedo comprar una TPU v7 para mi servidor?

7. ¿Puedo comprar una TPU v7 para mi servidor?

No. Las TPUs de Google son procesadores propietarios que solo se pueden usar a través de Google Cloud Platform (GCP). Google no vende las tarjetas físicas a terceros. Si quieres tener el hardware en tu propio sótano (On-Premise), tus opciones son NVIDIA o AMD.

8. ¿Qué es el "Superchip" Blackwell Ultra?

8. ¿Qué es el "Superchip" Blackwell Ultra?

Es una configuración donde NVIDIA combina sus mejores GPUs Blackwell (ahora actualizadas a la serie B300 con más memoria) con sus propias CPUs Grace basadas en ARM, todo conectado por NVLink de alta velocidad. Esto crea un «nodo» de computación que funciona como un solo organismo, eliminando los cuellos de botella de la comunicación PCIe tradicional.

9. ¿Qué papel juega MediaTek en las TPUs de Google?

9. ¿Qué papel juega MediaTek en las TPUs de Google?

A partir de la generación v7 Ironwood, se ha reportado que Google colabora con MediaTek para diseñar ciertos bloques de IP (Propiedad Intelectual) del chip, probablemente relacionados con la gestión de energía y la interconexión SerDes. Esto permite a Google acelerar el desarrollo y aprovechar la experiencia de MediaTek en chips eficientes, mientras Google se centra en los núcleos tensoriales (Matrix Multiply Units).

10. ¿Merece la pena esperar a Rubin o comprar Blackwell ahora?

10. ¿Merece la pena esperar a Rubin o comprar Blackwell ahora?

En el mundo de la IA, esperar un año es una eternidad. Si tienes una necesidad de negocio hoy, Blackwell (o Blackwell Ultra) es la herramienta que necesitas. Rubin será revolucionaria en 2026/27, pero para entonces la competencia habrá cambiado de nuevo. La demanda es tan alta que «lo que puedas conseguir» suele ser la mejor estrategia.