En los foros de desarrolladores, en las salas de juntas y en los hilos de Twitter (ahora X), circula una narrativa persistente: «Google llegó tarde. Gemini es solo una respuesta reactiva a ChatGPT. Básicamente, están copiando la tarea de OpenAI».

En 2025, con el lanzamiento de Gemini 3.0, esta afirmación no solo es simplista; es técnicamente incorrecta.

Si bien es cierto que OpenAI ganó la batalla de la percepción pública y el «Product Market Fit» con el lanzamiento de ChatGPT en 2022, asumir que la tecnología subyacente de Google es una derivación de la de OpenAI es ignorar la historia de la computación moderna. La realidad es mucho más fascinante: estamos ante dos gigantes que, partiendo del mismo «Big Bang» científico, eligieron caminos evolutivos radicalmente opuestos.

Este artículo es una inmersión profunda y técnica para desmontar el mito. Exploraremos por qué Gemini no se basa en GPT, quién inventó realmente la tecnología que mueve el mundo hoy, y cómo la arquitectura de Gemini 3.0 representa una ruptura filosófica con todo lo que conocíamos hasta ahora.

1. El Ancestro Común: Google y el "Big Bang" del Transformer

Para entender por qué Gemini no es un «hijo» de GPT, debemos viajar a 2017. En ese año, el mundo del Procesamiento de Lenguaje Natural (NLP) estaba estancado con redes neuronales recurrentes (RNNs) y LSTMs, que eran lentas y malas para recordar contextos largos.

Fue entonces cuando un equipo de investigadores de Google Brain publicó el paper más influyente de la década: «Attention Is All You Need«.

El Nacimiento del Transformer

Los autores (Vaswani, Shazeer, Parmar, Uszkoreit, Jones, Gomez, Kaiser y Polosukhin) propusieron una nueva arquitectura llamada Transformer. Esta arquitectura introdujo el mecanismo de «auto-atención» (self-attention), permitiendo que un modelo procesara todas las palabras de una frase simultáneamente y entendiera la relación entre ellas, sin importar cuán distantes estuvieran.

El Hecho Irrefutable: La «T» de GPT significa Transformer. OpenAI no inventó la arquitectura que hace posible a GPT. Google lo hizo.

Por lo tanto, decir que Gemini se basa en GPT es como decir que un coche eléctrico moderno se basa en un Ford T. Ambos se basan en la invención de la rueda y el motor, pero la ingeniería moderna es una evolución paralela, no una copia directa. OpenAI tomó el invento de Google y tuvo la brillantez de escalarlo (hacerlo masivo) y enfocarlo en la generación (Decodificador), mientras que Google inicialmente se centró en la comprensión (Codificador, con BERT).

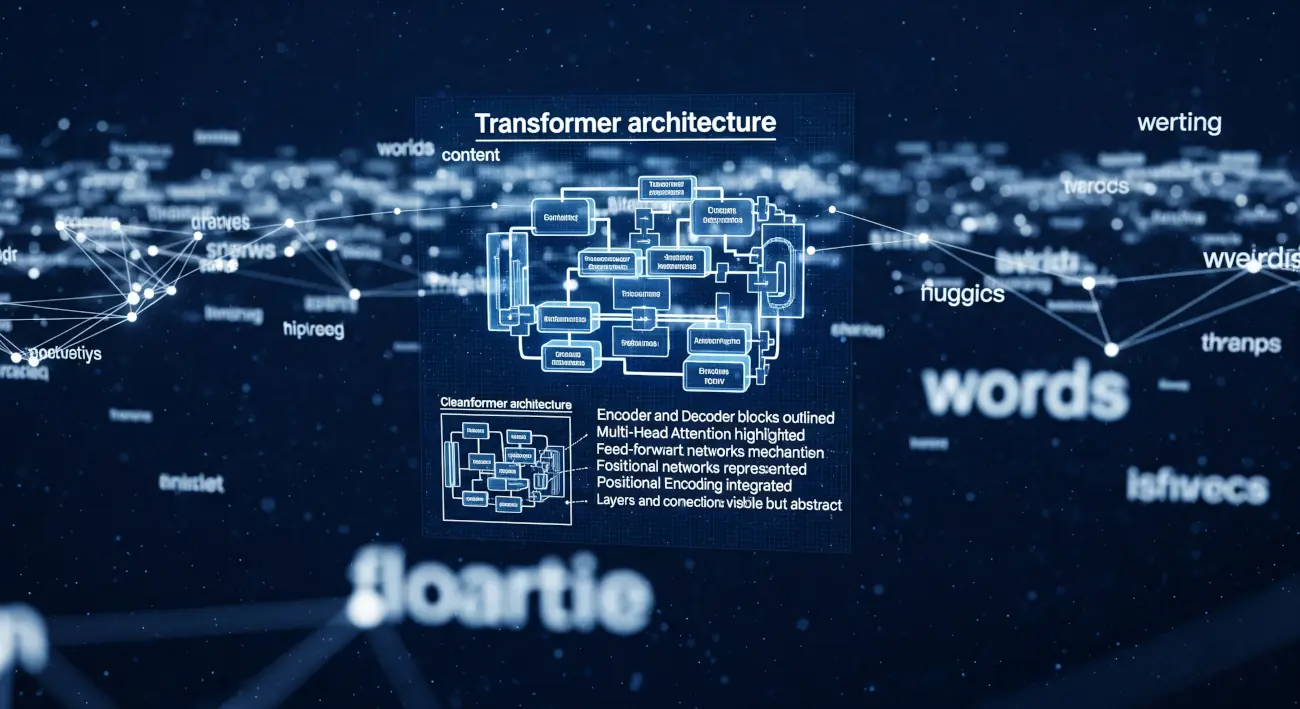

2. La Gran Divergencia: Generación vs. Comprensión (2018-2023)

Tras la invención del Transformer, los caminos de ambas compañías se separaron. Esta divergencia es la clave para entender por qué sus modelos actuales son bestias diferentes.

La Apuesta de OpenAI: El Decodificador Puro (GPT)

OpenAI vio algo que otros pasaron por alto: la Escala. Apostaron todo a la arquitectura Decoder-Only del Transformer. Su hipótesis era que si alimentabas al modelo con suficiente texto y aumentabas los parámetros exponencialmente, la «inteligencia» emergería.

-

GPT-1, 2 y 3: Fueron iteraciones de fuerza bruta sobre texto. Eran modelos ciegos y sordos. Solo conocían palabras.

-

El Enfoque Modular: Cuando OpenAI quiso añadir imágenes (GPT-4), inicialmente tuvo que «pegar» sistemas de visión al cerebro de texto. Fue una ingeniería de integración brillante, pero arquitectónicamente era un sistema compuesto.

La Apuesta de Google: Multimodalidad y Comprensión (BERT, PaLM, Gemini)

Google, teniendo el buscador más grande del mundo, se centró inicialmente en entender la intención (BERT). Pero sus laboratorios (DeepMind y Brain) sabían que el futuro no era solo texto.

-

El Proyecto Gemini: A diferencia de GPT, que evolucionó de texto a multimodal, Gemini fue concebido desde su «génesis» para ser nativamente multimodal.

-

La Diferencia Filosófica: Google no quería un modelo que «leyera sobre un gato». Quería un modelo que hubiera visto millones de videos de gatos, escuchado sus maullidos y leído la palabra «gato», todo entremezclado en el mismo proceso de entrenamiento.

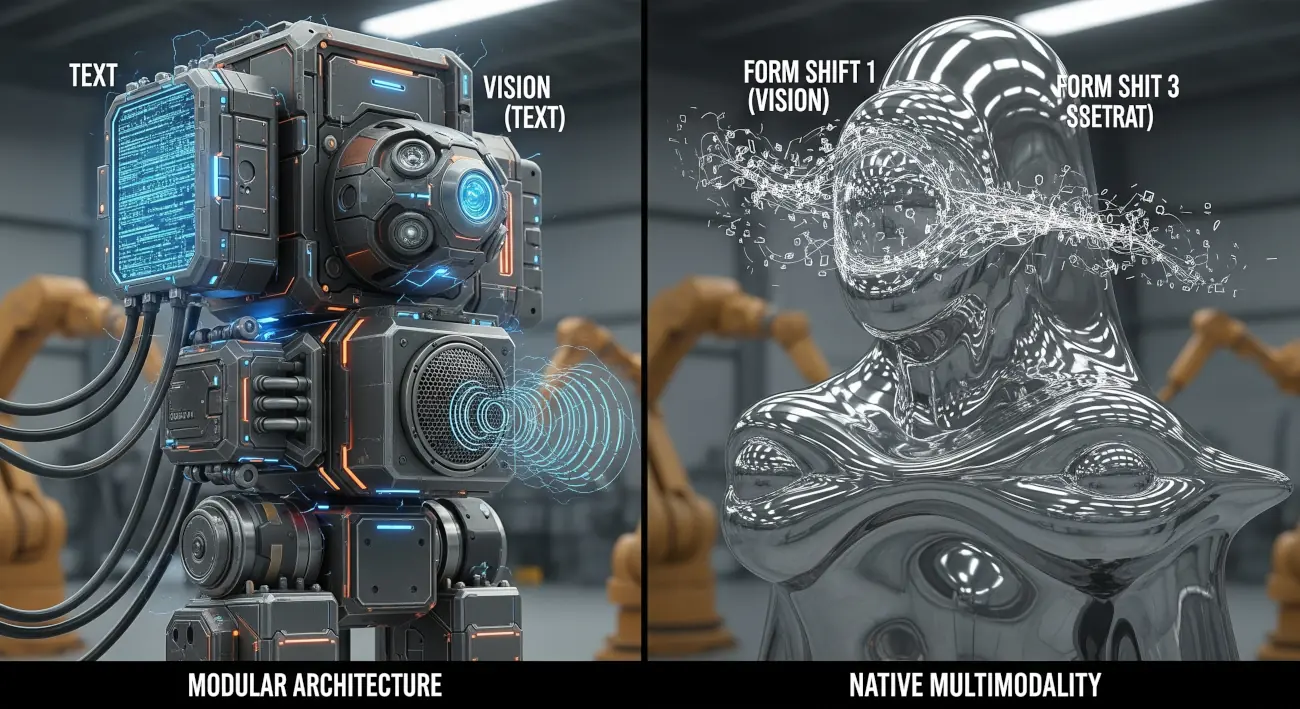

3. Arquitectura Técnica: Multimodalidad Nativa vs. Aumentada

Llegamos al núcleo del mito. Muchos desarrolladores creen que Gemini funciona igual que GPT-4o, pero bajo el capó, la ingeniería es distinta.

El Enfoque «Frankenstein» (Inicialmente GPT)

Imagina que quieres crear un superhumano.

-

El enfoque inicial de los LLMs multimodales era entrenar un cerebro excelente para escribir (LLM).

-

Luego, entrenar unos ojos excelentes (Vision Encoder).

-

Luego, conectarlos con un adaptador.

-

Resultado: El cerebro «traduce» la imagen a conceptos de texto internos. Pierde matices. Si la imagen tiene un tono emocional sutil, el adaptador de texto podría perderlo.

El Enfoque Nativo (Gemini y la evolución hacia 3.0)

Gemini fue entrenado de forma distinta. Su dataset de entrenamiento no separaba texto de imagen.

-

Tokens Multimodales: Para Gemini, una secuencia de entrenamiento podría ser:

[Texto: "Mira esto"] -> [Video Frame 1] -> [Audio: Sonido de explosión] -> [Texto: "Wow"]. -

Comprensión Profunda: Esto significa que Gemini no «traduce» el video a texto para entenderlo. Entiende el video en su formato nativo. Puede razonar sobre el movimiento, la física y el sonido de forma conjunta, algo que los modelos basados puramente en adaptadores luchan por hacer con la misma fidelidad.

4. Gemini 3.0: El Salto Cuántico de 2025

Con la llegada de Gemini 3.0, Google no está tratando de «alcanzar» a GPT-5; está intentando cambiar el campo de juego. Gemini 3.0 cristaliza la visión que Google ha perseguido durante una década, alejándose aún más de la arquitectura GPT tradicional.

¿Qué hace a Gemini 3.0 fundamentalmente diferente?

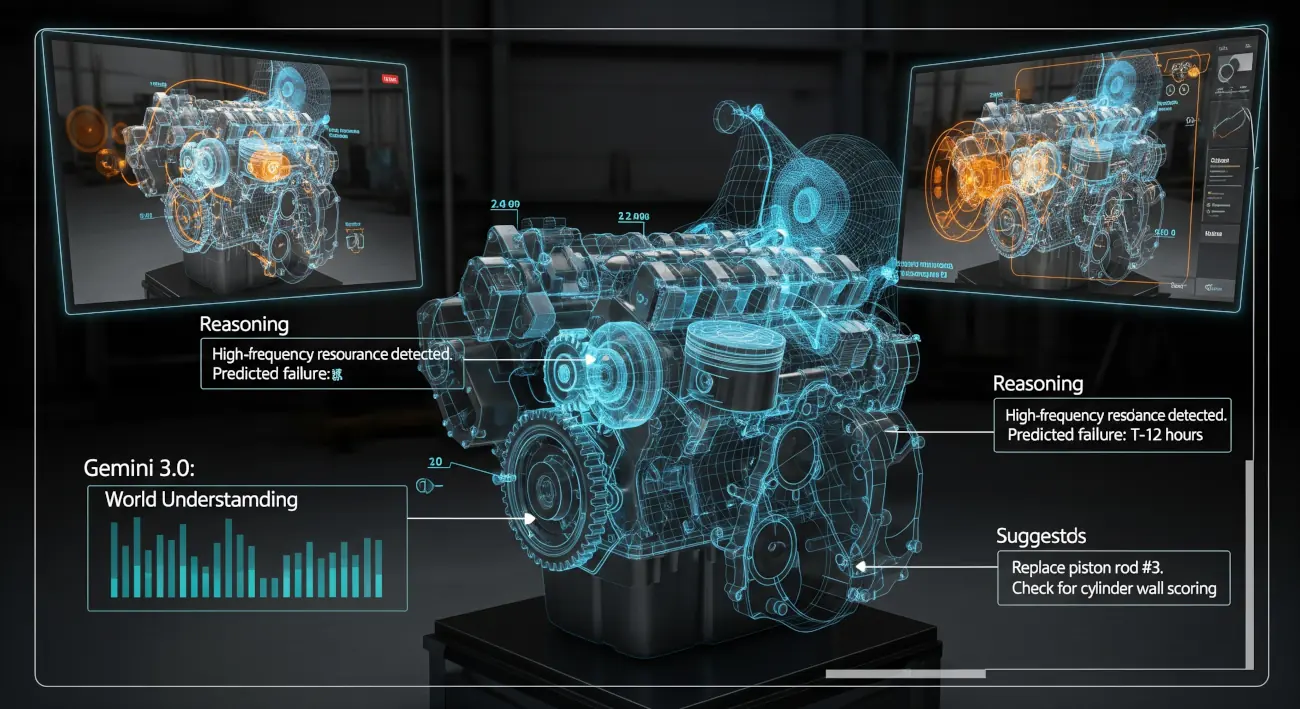

A. Razonamiento del Mundo Físico (World Models)

Mientras que GPT se basa en la lógica del lenguaje, Gemini 3.0 incorpora principios de World Models. Ha sido entrenado con tanto vídeo del mundo real que ha empezado a «intuir» la física.

-

Si le pides a GPT-5 que describa qué pasa si sueltas un vaso, usa su conocimiento textual probabilístico.

-

Gemini 3.0 puede simular mentalmente la caída basándose en su comprensión visual-espacial. Esto lo hace superior en robótica y tareas de agente en el mundo real.

B. Memoria de Contexto «Infinita» y Atención Lineal

La arquitectura Transformer original tiene un coste cuadrático (si doblas el texto, el coste de computación se cuadruplica). Gemini 3.0 ha implementado variantes de Ring Attention y arquitecturas híbridas (posiblemente integrando Mamba/SSM) que permiten ventanas de contexto que dejan de ser una «ventana» para ser una «biblioteca».

-

Estamos hablando de procesar millones de tokens de forma trivial. Esto no se basa en la arquitectura GPT original; es una evolución propietaria de DeepMind.

C. Agentes Autónomos Nativos

Gemini 3.0 no está diseñado solo para ser un chatbot. Su arquitectura está orientada a la acción. Puede navegar por interfaces de usuario (GUIs), ver la pantalla de un ordenador y actuar sobre ella como un humano, no analizando el código HTML subyacente (como hacen los agentes antiguos), sino «viendo» los botones y los menús visualmente.

5. Desmontando los Argumentos Comunes

Vamos a atacar directamente las frases que se escuchan en la comunidad.

- Mito: «El código de Gemini es un fork de GPT.»

- Realidad: Falso. Gemini está construido sobre JAX y se ejecuta en TPUs (Tensor Processing Units), el hardware propio de Google. GPT está construido (generalmente) sobre PyTorch y se ejecuta en GPUs NVIDIA. Son ecosistemas de software y hardware completamente diferentes.

- Mito: «Google solo saca Gemini porque ChatGPT tuvo éxito.»

- Realidad: Parcialmente cierto en timing, falso en tecnología. Google tenía modelos como LaMDA y Meena años antes de ChatGPT, pero sufría del «Dilema del Innovador»: no querían lanzarlos para no canibalizar su Buscador y por riesgos de seguridad. El éxito de ChatGPT solo forzó a Google a lanzar la tecnología que ya tenían en el laboratorio, acelerando el desarrollo de Gemini.

- Mito: «Al final, todos son Transformers, así que son lo mismo.»

- Realidad: Eso es como decir que un motor de Fórmula 1 y un motor de cortacésped son lo mismo porque ambos son «motores de combustión interna». La arquitectura de atención, la gestión de tokens, el entrenamiento MoE (Mixture of Experts) y la alineación RLHF (Reinforcement Learning from Human Feedback) son recetas secretas y muy distintas en cada casa.

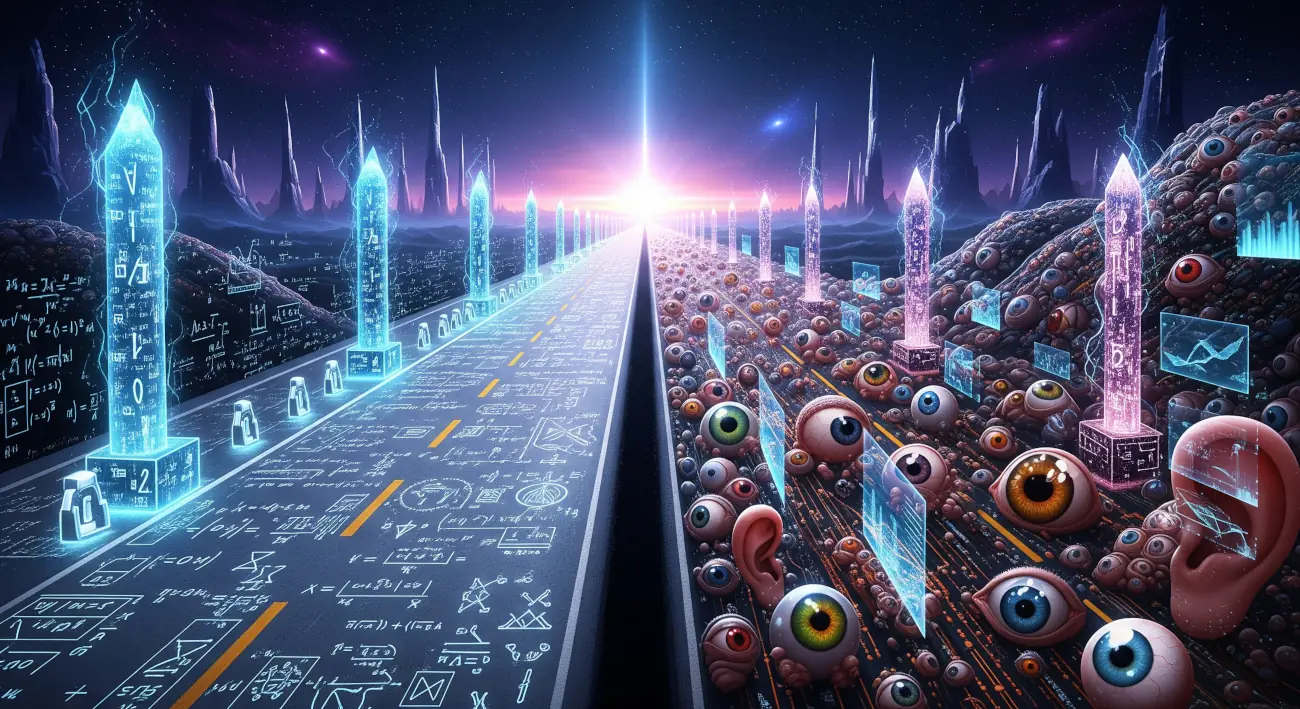

6. Conclusión: La Era de la Divergencia

En 2025, decir que Gemini se basa en GPT es ignorar la realidad técnica. Estamos presenciando una especiación en la inteligencia artificial.

-

OpenAI (GPT-5): Sigue el camino del Razonamiento Simbólico y Lógico. Buscan crear el cerebro más inteligente, racional y capaz de resolver problemas complejos mediante la computación y el lenguaje.

-

Google (Gemini 3.0): Sigue el camino de la Omnipresencia Sensorial y la Información. Buscan crear una IA que «viva» en el flujo de datos del mundo (video, audio, tiempo real) y tenga una memoria perfecta.

Ambos gigantes se apoyan en hombros de gigantes (los investigadores del Transformer de 2017), pero sus miradas están puestas en horizontes muy diferentes. Como desarrolladores y expertos en tecnología, es nuestra responsabilidad entender estas diferencias para elegir la herramienta adecuada, en lugar de perpetuar mitos de «copias» que no hacen justicia a la increíble ingeniería detrás de ambos modelos.

💬 Preguntas y Respuestas (FAQ)

1. ¿Es cierto que Google inventó la tecnología que usa ChatGPT?

1. ¿Es cierto que Google inventó la tecnología que usa ChatGPT?

Sí, es técnicamente correcto. La arquitectura Transformer, que es la «T» en ChatGPT, fue presentada en el paper «Attention Is All You Need» (2017) por investigadores de Google Brain. Sin esa invención, los modelos de lenguaje modernos (LLMs) como los conocemos no existirían. OpenAI tuvo la visión de aplicar esa arquitectura a modelos generativos masivos antes que nadie, pero los «ladrillos» fundamentales son tecnología de Google.

2. ¿Cuál es la diferencia principal entre "Multimodalidad Nativa" (Gemini) y "Multimodalidad Aumentada" (GPT antiguos)?

2. ¿Cuál es la diferencia principal entre "Multimodalidad Nativa" (Gemini) y "Multimodalidad Aumentada" (GPT antiguos)?

La multimodalidad aumentada entrena componentes separados (un modelo para ver, otro para leer) y los conecta. Esto puede generar pérdidas de información o matices. La multimodalidad nativa (Gemini 3.0) entrena una sola red neuronal con todos los tipos de datos a la vez desde el principio. Para Gemini, una imagen no se traduce a texto; es un input nativo tan comprensible como una palabra, lo que permite un razonamiento cruzado mucho más fluido.

3. ¿Qué aporta Gemini 3.0 que no tenga GPT-5?

3. ¿Qué aporta Gemini 3.0 que no tenga GPT-5?

Aunque ambos son modelos de frontera, Gemini 3.0 destaca por su ventana de contexto masiva (capacidad de «recordar» o procesar millones de tokens a la vez) y su integración profunda con el ecosistema de información de Google (YouTube, Search, Workspace). Además, su arquitectura nativa de video le da una ventaja en la comprensión de la física y la dinámica del mundo real, algo en lo que los modelos puramente textuales o híbridos suelen quedarse atrás.

4. ¿Por qué se dice que Google tenía "miedo" de lanzar su IA antes que OpenAI?

4. ¿Por qué se dice que Google tenía "miedo" de lanzar su IA antes que OpenAI?

Se conoce como el «Dilema del Innovador». Google tenía modelos de chat muy avanzados (como LaMDA) años antes de ChatGPT. Sin embargo, lanzar un chatbot que pudiera dar información falsa suponía un riesgo enorme para su reputación y, más importante aún, amenazaba su modelo de negocio principal (la Búsqueda y los anuncios). OpenAI, al ser una startup (en ese momento), tenía mucho menos que perder y pudo ser más agresiva en el lanzamiento público.

5. ¿Están escritos Gemini y GPT en el mismo lenguaje de programación?

5. ¿Están escritos Gemini y GPT en el mismo lenguaje de programación?

A nivel de framework de Deep Learning, suelen diferir. OpenAI y la mayoría de la industria utilizan PyTorch (desarrollado originalmente por Meta) y hardware NVIDIA. Google utiliza su propio framework, JAX (o TensorFlow en versiones anteriores), y entrena sus modelos en su propio hardware propietario, las TPUs (Tensor Processing Units). Son ecosistemas tecnológicos completamente paralelos.

6. ¿Qué es el "Prompt Injection" y afecta igual a ambos modelos?

6. ¿Qué es el "Prompt Injection" y afecta igual a ambos modelos?

Es un ataque donde el usuario engaña a la IA para que ignore sus instrucciones de seguridad. Afecta a ambos porque es una vulnerabilidad inherente a los LLMs (no se puede separar perfectamente la instrucción del dato). Sin embargo, debido a sus diferentes arquitecturas de entrenamiento y alineación (RLHF), cada modelo tiene «resistencias» diferentes. Gemini 3.0, al tener una comprensión multimodal más profunda, puede ser susceptible a nuevos tipos de inyecciones visuales (imágenes con texto oculto malicioso) que GPT-5 procesaría de forma distinta.

7. ¿Podrá Gemini 3.0 ejecutarse en mi ordenador local?

7. ¿Podrá Gemini 3.0 ejecutarse en mi ordenador local?

El modelo completo Gemini 3.0 (Ultra/Pro) es demasiado grande para cualquier ordenador de consumo. Sin embargo, Google ha impulsado la familia Gemini Nano, versiones destiladas y eficientes diseñadas para ejecutarse localmente en dispositivos Android y navegadores Chrome. OpenAI no tiene una presencia tan fuerte en modelos locales «on-device», enfocándose más en la API de nube.

8. ¿Qué papel juega DeepMind en todo esto?

8. ¿Qué papel juega DeepMind en todo esto?

DeepMind era una empresa británica adquirida por Google, famosa por AlphaGo. Recientemente, Google fusionó «Google Brain» (creadores del Transformer) y «DeepMind» para formar Google DeepMind. Gemini es el primer gran producto fruto de esta fusión unificada, combinando la experiencia en ingeniería de Brain con la experiencia en aprendizaje por refuerzo y agentes autónomos de DeepMind.

9. ¿Es la "ventana de contexto infinita" de Gemini realmente infinita?

9. ¿Es la "ventana de contexto infinita" de Gemini realmente infinita?

Técnicamente no es infinita, pero para propósitos prácticos humanos, se acerca. Hablamos de millones de tokens (suficiente para miles de libros o cientos de horas de video). La limitación ya no es tanto la memoria de la IA, sino la velocidad de procesamiento y el coste de computación. Arquitecturas como Ring Attention en Gemini 3.0 permiten que este contexto escale mucho mejor que en los Transformers tradicionales.

10. ¿Quién ganará la carrera de la IA: Google o OpenAI?

10. ¿Quién ganará la carrera de la IA: Google o OpenAI?

Es probable que no haya un solo ganador. Estamos viendo una especialización. OpenAI (con Microsoft) parece dominar en el ámbito de la productividad empresarial y el razonamiento lógico puro (Coding, Matemáticas). Google parece posicionado para dominar en la IA de consumo, asistentes personales omniscientes y comprensión multimedia (Video, YouTube, Móvil). Es un duopolio de innovación donde la competencia feroz acelera el progreso para todos.