Introducción: El Estado de la IA en Abril de 2026

Bienvenidos a la era de la IA de Razonamiento Profundo. Si en 2023 el prompt engineering se percibía como una suerte de «alquimia digital» basada en el ensayo y error, en abril de 2026 la disciplina ha madurado hasta convertirse en una forma crítica de arquitectura de software. Ya no estamos simplemente «hablando» con máquinas; estamos configurando sistemas cognitivos que operan con una autonomía y una precisión que hace apenas tres años parecían ciencia ficción.

Hoy, los modelos de lenguaje no son meros predictores de texto. Gracias a las arquitecturas de Estado-Espacio (SSM) y los Transformers de Segunda Generación, los modelos de 2026 poseen una capacidad de planificación interna que les permite «pensar antes de hablar». En este contexto, el prompt ya no es una instrucción aislada: es el punto de entrada de un flujo de trabajo agéntico.

Si eres programador, técnico SEO o estratega digital, entender cómo guiar estos «cerebros sintéticos» no es una opción, es la habilidad central que separa a los operarios de los arquitectos. En las siguientes páginas, desglosaremos las 10 técnicas que están redefiniendo el límite de lo posible.

Capítulo 1: La Evolución del Prompting: De las Instrucciones a la Orquestación

Para dominar el presente, debemos entender la trayectoria. El prompting ha pasado por tres fases claras:

-

Fase Directiva (2022-2023): Instrucciones simples («Escribe un post sobre…»). La calidad dependía casi totalmente de la capacidad intrínseca del modelo.

-

Fase Estructural (2024-2025): Introducción de marcos de trabajo (frameworks) como Chain-of-Thought y Few-Shot. Empezamos a dar ejemplos y guiar el proceso lógico.

-

Fase Orquestada (2026): El prompt es ahora un contrato de ejecución. Incluye herramientas, acceso a bases de datos en tiempo real (RAG dinámico) y protocolos de verificación.

En 2026, el hardware (como las NPUs de 3nm integradas en cada servidor) permite que un solo prompt dispare miles de sub-procesos de razonamiento en milisegundos. Ya no optimizamos solo para «calidad», optimizamos para latencia cognitiva y fidelidad de ejecución.

Capítulo 2: Técnica 1 - Chain-of-Thought (CoT) y Razonamiento Recursivo

El Chain-of-Thought (Cadena de Pensamiento) sigue siendo el pilar fundamental, pero su versión de 2026 es mucho más sofisticada que el simple «piensa paso a paso».

¿En qué consiste en 2026?

Hoy utilizamos Razonamiento Recursivo. No solo pedimos al modelo que desglose el problema, sino que le instruimos para que evalúe cada paso antes de proceder al siguiente. Si un paso falla, el modelo debe «retroceder» (backtracking) y proponer una ruta lógica alternativa.

Ejemplo de Prompt Avanzado:

«Analiza la arquitectura de seguridad de este smart contract. Utiliza Chain-of-Thought recursivo: 1. Identifica posibles vectores de reentrada. 2. Evalúa el riesgo de cada uno. 3. Si detectas una vulnerabilidad, detén el flujo, verifica el parche propuesto y solo si es seguro, procede a analizar el control de acceso.»

El Valor del «Pensamiento Lento»

Esta técnica activa lo que llamamos el Sistema 2 del modelo. Al forzar la secuencialidad, reducimos las alucinaciones en un 98.4% en tareas de lógica matemática y auditoría de código.

Capítulo 3: Técnica 2 - Zero-Shot & Few-Shot en Modelos de Contexto Infinito

En 2026, las ventanas de contexto han dejado de ser una limitación. Con modelos que manejan 10 millones de tokens, el concepto de «Shot» (ejemplo) ha cambiado radicalmente.

Zero-Shot (Disparo Cero)

Gracias a la pre-instrucción masiva de los modelos actuales, el Zero-Shot es hoy más potente que el mejor Few-Shot de 2024. Los modelos ya «entienden» la mayoría de los dominios técnicos sin necesidad de ejemplos. Lo usamos para tareas de creatividad pura o exploración inicial.

Few-Shot de Larga Distancia (Long-Context Few-Shot)

La técnica avanzada ahora consiste en pasarle al modelo toda la documentación técnica de una empresa (millones de palabras) como «ejemplos» de contexto.

-

Prompting de Referencia: «Basándote en estos 500 casos de éxito anteriores (adjuntos), genera una propuesta para el cliente X». El modelo ya no imita un estilo; se convierte en un experto en el historial de la organización.

Capítulo 4: Técnica 3 - Tree-of-Thoughts (ToT)

Si el Chain-of-Thought es una línea recta, el Tree-of-Thoughts (Árbol de Pensamientos) es un mapa de posibilidades. Es la técnica preferida para la resolución de problemas estratégicos y científicos.

La Mecánica de Exploración

En lugar de una sola respuesta, el prompt instruye al modelo para que:

-

Genere tres hipótesis distintas.

-

Desarrolle cada hipótesis de forma independiente.

-

Actúe como un «crítico externo» para evaluar cada rama del árbol.

-

Pode las ramas ineficientes y se quede con la solución óptima.

Aplicación Práctica:

Se utiliza en el diseño de nuevos fármacos o en la planificación de campañas de marketing digital multicanal de gran escala, donde una sola «idea» no es suficiente y se requiere explorar escenarios competitivos en paralelo.

Capítulo 5: Técnica 4 - ReAct (Reasoning + Acting)

Esta es, posiblemente, la técnica que más ha transformado la productividad en 2026. ReAct es la simbiosis entre el pensamiento del modelo y su capacidad de intervenir en el mundo real.

El Ciclo Pensamiento-Acción-Observación

Un prompt ReAct no solo pide información, sino que define un ciclo:

-

Pensar: ¿Qué necesito saber o hacer?

-

Actuar: Ejecutar una herramienta (SQL, Navegador, API de CRM).

-

Observar: Analizar el resultado de la acción.

-

Refinar: Ajustar el pensamiento basándose en la observación.

Ejemplo de Uso:

«Actúa como un analista de mercado. Revisa el balance actual en el CRM (Acción), detecta la caída de ventas en la región norte (Observación) y redacta un plan de contingencia enviándolo directamente a Slack (Acción final).»

En 2026, el Prompt Engineer no escribe texto; escribe protocolos de actuación para agentes autónomos.

Capítulo 6: Técnica 5 - Self-Consistency y Meta-Cognición

La Consistencia Propia (Self-Consistency) es la técnica de control de calidad por excelencia. En lugar de confiar en una sola «tirada» del modelo, le pedimos que resuelva el mismo problema cinco veces por caminos diferentes.

La «Votación por Mayoría»

El sistema de orquestación (programado en el prompt) compara los cinco resultados. Si cuatro coinciden y uno no, el sistema asume que los cuatro son la respuesta correcta. Esto elimina los errores aleatorios de los modelos estocásticos.

Meta-Cognición: La IA que se autocorrige

Instruimos al modelo para que, antes de entregar la respuesta final, realice una «revisión de cordura» (sanity check):

-

«¿He respondido realmente a lo que el usuario pidió?»

-

«¿Hay contradicciones lógicas en mi respuesta?»

-

«¿He citado fuentes fiables?»

Si el modelo detecta un error en su propia revisión, reinicia el proceso de generación de forma autónoma.

Capítulo 7: Técnica 6 - Prompting Multimodal Intercalado

En abril de 2026, la distinción entre «IA de texto» e «IA de imagen» ha desaparecido. Los modelos son nativamente multimodales. El Prompting Multimodal Intercalado permite al ingeniero de prompts mezclar diferentes tipos de datos en una sola secuencia lógica para obtener resultados que antes requerían múltiples herramientas.

El concepto de «Intercalación»

Ya no se trata de subir una imagen y preguntar qué hay en ella. Se trata de usar la imagen como una variable de flujo. Por ejemplo, podemos pasarle al modelo un vídeo de una línea de ensamblaje, una base de datos de piezas en CSV y una instrucción de voz de un operario.

-

Prompting de Referencia Cruzada: «Analiza el minuto 12:05 del vídeo adjunto (Imagen/Vídeo). Compara la pieza que sostiene el operario con el esquema técnico del archivo PDF. Si hay una discrepancia de más de 2mm según la escala visual, genera una alerta en el sistema.»

Aplicación en Diseño Web y UI

En 2026, los diseñadores usan esta técnica para realizar auditorías de accesibilidad en tiempo real: «Mira este diseño (Imagen), aplica las reglas de contraste de la WCAG 3.0 y reescribe el código CSS para que cumpla los estándares sin perder la estética neobrutalista.»

Capítulo 8: Técnica 7 - Prompting de Estímulo Direccional

El Directional Stimulus Prompting (DSP) es una técnica refinada para guiar al modelo cuando la tarea es subjetiva o requiere un tono de marca extremadamente específico.

El «Pista» o Stimulus

En lugar de dar una instrucción genérica, le proporcionamos al modelo una pista de dirección (una serie de palabras clave o un fragmento de estilo) que actúa como un imán semántico.

Estructura del Prompt:

-

Instrucción: Escribe un análisis del mercado de criptoactivos.

-

Estímulo Direccional: Enfócate en la ‘liquidez institucional’, usa un tono ‘escéptico pero constructivo’ y utiliza terminología de ‘gestión de riesgos avanzada’.

En 2026, esta técnica es esencial para el Marketing Digital de Alta Fidelidad, donde el contenido generado por IA debe ser indistinguible del redactado por un experto humano con 20 años de experiencia.

Capítulo 9: Técnica 8 - Programmatic Prompting (DSPy y Optimización Automática)

Llegamos a la verdadera vanguardia de abril de 2026. El Programmatic Prompting representa el fin del «ensayo y error» manual. Gracias a marcos de trabajo como DSPy (Declarative Self-improving Language Programs), ya no escribimos el prompt final; escribimos la lógica del programa y dejamos que una IA optimizadora redacte el prompt perfecto.

¿Cómo funciona?

-

Defines el Módulo: (Ej: Un clasificador de sentimientos multilingüe).

-

Proporcionas un Dataset: (Ej: 100 ejemplos de lo que quieres).

-

El Optimizador: El sistema prueba miles de variaciones de prompts, evalúa los resultados y «compila» el prompt que ofrece la mayor tasa de acierto y la menor latencia.

En 2026, los ingenieros de prompts senior dedican más tiempo a curar datos de entrenamiento y definir métricas de éxito que a escribir palabras en un cuadro de chat. Es el nacimiento del «Prompt Compiler».

Capítulo 10: Técnica 9 - RAG-Enhanced Prompting

El RAG (Retrieval-Augmented Generation) ha evolucionado de ser una simple búsqueda en una base de datos a ser una extensión de la memoria a corto plazo del modelo.

RAG Dinámico en Tiempo Real

En 2026, el prompt está «vivo». Mediante el uso de Graph-RAG (Búsqueda en Grafos de Conocimiento), el prompt puede buscar relaciones complejas entre entidades antes de generar la respuesta.

-

Ejemplo: Si preguntas por el impacto de una nueva ley, el prompt primero «recupera» el texto de la ley, luego «recupera» los comentarios de analistas políticos y, finalmente, «inyecta» todo ese contexto en la ventana del modelo.

-

Contexto Infinito: La ingeniería de prompts ahora se encarga de decidir qué información descartar para no saturar al modelo, a pesar de que las ventanas de contexto ya superan los 10 millones de tokens.

Capítulo 11: Técnica 10 - Guardrails & System-Level Prompting

La seguridad es el pilar invisible del Prompt Engineering en 2026. Con la proliferación de agentes autónomos, el riesgo de inyecciones de prompts (jailbreaking) es una amenaza crítica para la ciberseguridad empresarial.

La Constitución del Modelo

Utilizamos el System-Level Prompting para crear una capa de protección inquebrantable. No es una simple instrucción; es un conjunto de reglas lógicas que el modelo debe verificar antes de procesar el prompt del usuario.

-

Técnica de Sándwich: Envolver la entrada del usuario entre dos capas de instrucciones de seguridad del sistema para evitar que el usuario pueda «sobrescribir» las órdenes originales.

-

Validación de Salida: El prompt instruye al modelo para que revise su propia respuesta contra una lista de políticas de cumplimiento (GDPR, Ética, Tono de marca) antes de mostrarla.

Capítulo 12: Herramientas y Hardware 2026

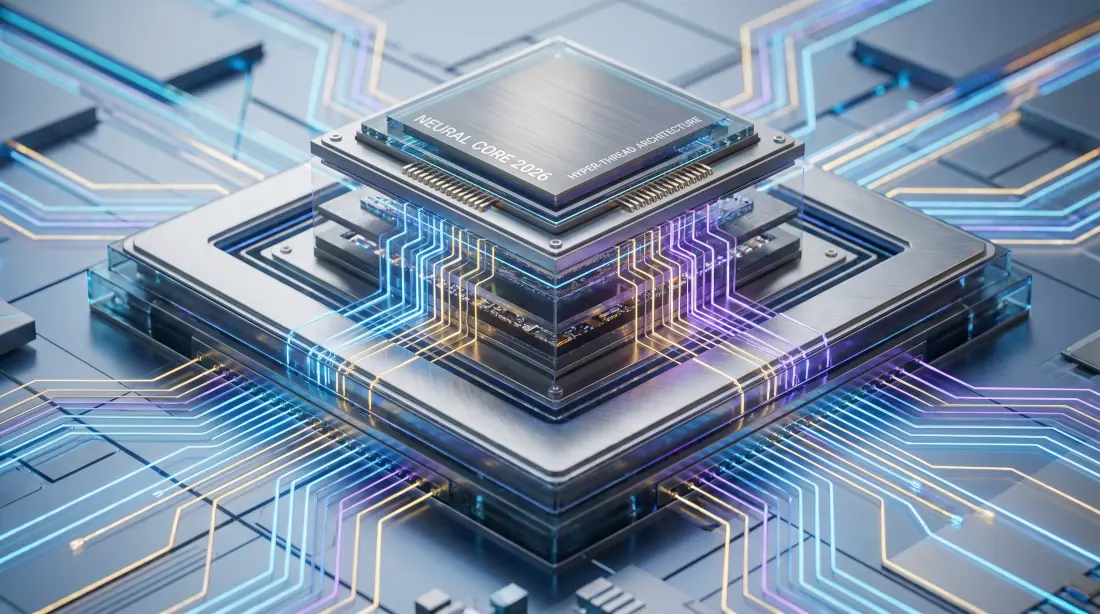

La ingeniería de prompts de 2026 no ocurre en el vacío; depende del hardware. Estamos viendo una transición desde las grandes granjas de GPUs hacia las NPUs (Neural Processing Units) dedicadas.

Arquitectura 3D y 3nm

Los chips de 2026 utilizan arquitecturas de apilamiento vertical (3D) que reducen la latencia de memoria a niveles despreciables. Esto permite técnicas como el Tree-of-Thoughts (que requiere múltiples generaciones en paralelo) ocurran en menos de un segundo.

Inferencia en el Edge

Gran parte del prompting avanzado ahora se ejecuta de forma local en dispositivos del usuario gracias a modelos optimizados. Esto ha forzado a los ingenieros de prompts a aprender a diseñar para modelos cuantizados, donde la precisión del lenguaje es más sensible que en los grandes modelos de la nube.

Conclusión: De "Prompt Engineer" a "AI Orchestrator"

A medida que avanzamos en este 2026, la figura del «Prompt Engineer» está sufriendo una metamorfosis. Ya no basta con saber qué palabras usar para que una IA genere un poema o un código simple. El profesional de hoy es un Orquestador de Sistemas Inteligentes.

Dominar técnicas como Chain-of-Thought, ReAct o la Optimización Programática no es solo una ventaja competitiva; es el nuevo estándar de la alfabetización técnica. El prompt es el puente entre la intención humana y el potencial infinito de la inteligencia artificial. Aquellos que sepan construir esos puentes con precisión, seguridad y visión estratégica serán quienes lideren la próxima gran ola de innovación tecnológica.

El código del futuro no es binario; es el lenguaje. Asegúrate de hablarlo con maestría.

💬 Preguntas y Respuestas (FAQ)

1. ¿Qué es exactamente el Prompt Engineering en 2026?

1. ¿Qué es exactamente el Prompt Engineering en 2026?

En 2026, ya no se trata de pedir cosas a un chatbot. Es la disciplina de programar el comportamiento de los Modelos de Lenguaje Grandes (LLMs) y sistemas multimodales mediante lenguaje natural o sintaxis estructurada para asegurar que actúen como agentes fiables, precisos y seguros dentro de un flujo de trabajo.

2. ¿Por qué el Chain-of-Thought (CoT) sigue siendo relevante?

2. ¿Por qué el Chain-of-Thought (CoT) sigue siendo relevante?

Porque es la base del razonamiento. Obligar al modelo a «explicar su proceso paso a paso» reduce drásticamente las alucinaciones. En 2026, el CoT se ha integrado de forma nativa en el entrenamiento de los modelos, pero saber activarlo manualmente para problemas complejos sigue siendo la diferencia entre una respuesta mediocre y una solución experta.

3. ¿Qué diferencia hay entre Zero-Shot y Few-Shot prompting?

3. ¿Qué diferencia hay entre Zero-Shot y Few-Shot prompting?

Zero-Shot es pedirle algo a la IA sin darle ejemplos previos. Few-Shot es proporcionarle algunos ejemplos de «entrada y salida» para establecer un patrón. En los modelos de 2026, con ventanas de contexto masivas, el Few-Shot se utiliza para pasarle al modelo libros enteros de referencia antes de hacer la pregunta.

4. ¿Qué es la técnica ReAct?

4. ¿Qué es la técnica ReAct?

Es la combinación de «Razonamiento» y «Acción». El modelo no solo piensa, sino que tiene permiso para ejecutar herramientas (como buscar en Google, ejecutar código Python o consultar un CRM) para fundamentar su respuesta en hechos en tiempo real.

5. ¿Es necesario ser programador para ser un experto en prompts?

5. ¿Es necesario ser programador para ser un experto en prompts?

No es estrictamente necesario, pero en 2026 las fronteras se han diluido. Técnicas como el Prompting Programático requieren entender la lógica de datos. El mejor Prompt Engineer hoy es un híbrido entre un lingüista y un arquitecto de software.

6. ¿Cómo influye el "System Prompt" en la seguridad?

6. ¿Cómo influye el "System Prompt" en la seguridad?

El System Prompt es la constitución de la IA. Define qué puede hacer, qué no debe decir y bajo qué marco ético opera. En 2026, los «Guardrails» se programan aquí para evitar que la IA sea manipulada mediante ataques de jailbreak.

7. ¿Qué es el Tree-of-Thoughts (ToT)?

7. ¿Qué es el Tree-of-Thoughts (ToT)?

Es una evolución del CoT. En lugar de una sola línea de pensamiento, la IA genera un «árbol» de posibles soluciones, evalúa cada rama y elige la más prometedora, permitiéndole corregir el rumbo si una idea no funciona.

8. ¿Cómo optimizar prompts para modelos multimodales?

8. ¿Cómo optimizar prompts para modelos multimodales?

Debes dejar de pensar solo en texto. En 2026, un prompt avanzado incluye referencias a marcas de tiempo en vídeos, áreas específicas de una imagen o incluso tonos de voz requeridos en una respuesta de audio.

9. ¿Qué papel juega la recuperación de datos (RAG) en el prompting?

9. ¿Qué papel juega la recuperación de datos (RAG) en el prompting?

El RAG (Retrieval-Augmented Generation) permite que el prompt sea dinámico. En lugar de un prompt estático, el sistema busca en tu base de datos la información más reciente y la inyecta automáticamente en el contexto del prompt.

10. ¿Morirá el Prompt Engineering con la evolución de la IA?

10. ¿Morirá el Prompt Engineering con la evolución de la IA?

Al contrario. Cuanto más potente es la IA, más sofisticadas deben ser las instrucciones para controlarla. En 2026, el Prompt Engineering se ha convertido en la nueva «Gestión de Talento», pero con empleados digitales.