Introducción: El Salto de la Pantalla Plana a la Computación Espacial en 2026

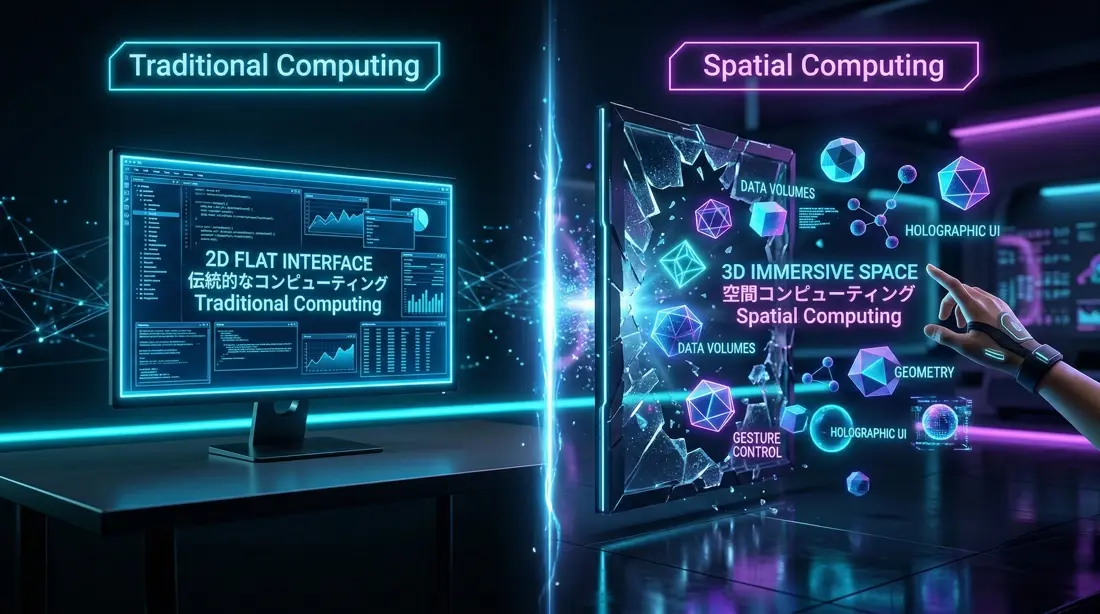

Durante más de cuarenta años, nuestra relación con la tecnología ha estado confinada a un rectángulo. Desde los pesados monitores CRT de los años 80 hasta los ultra-delgados smartphones de cristal que llevamos en el bolsillo, hemos interactuado con el mundo digital a través de una barrera bidimensional. Hemos sido observadores asomados a una ventana de píxeles.

A principios de 2026, esa ventana se ha roto.

La llegada del Apple Vision Pro y la maduración de visionOS no representaron simplemente el lanzamiento de un nuevo «gadget» de realidad virtual, sino el establecimiento de un nuevo paradigma fundamental: la Computación Espacial (Spatial Computing). Después de las dudas iniciales, las iteraciones de hardware y la consolidación del ecosistema de desarrolladores, hoy entendemos que el espacio físico que nos rodea es el nuevo lienzo de trabajo.

Diseñar y desarrollar para la computación espacial ya no es un experimento de I+D reservado para unas pocas corporaciones; es una competencia técnica crítica. Los desarrolladores web, los diseñadores UX/UI y los ingenieros de software se enfrentan al mayor reto de su carrera: aprender a añadir el eje Z (profundidad) a sus interfaces, gestionar la carga cognitiva en entornos inmersivos y entender que el usuario ya no usa un ratón, sino sus propios ojos y manos.

En esta guía definitiva, exhaustiva y actualizada a 2026, vamos a diseccionar qué es exactamente la computación espacial, cómo funciona la arquitectura técnica del ecosistema de Apple y, lo más importante, cómo puedes empezar hoy mismo a diseñar, programar y estructurar aplicaciones verdaderamente tridimensionales que dominarán la próxima década digital.

Capítulo 1: ¿Qué es Realmente la Computación Espacial? (Desmitificando la AR/VR)

El término «Computación Espacial» no fue inventado por Apple (fue acuñado por Simon Greenwold en 2003), pero ha sido la compañía de Cupertino la que lo ha estandarizado comercialmente para alejarse del estigma lúdico que perseguía a la Realidad Virtual (VR). Para desarrollar profesionalmente en 2026, primero debemos entender las fronteras que separan estas tecnologías.

1.1 La Evolución de las Realidades (VR, AR, MR y Computación Espacial)

El mercado tiende a confundir los acrónimos. Esta es la taxonomía técnica actual:

-

Realidad Virtual (VR – Virtual Reality): Entornos digitales 100% cerrados. El usuario se coloca un visor opaco y es transportado a un mundo sintético (un videojuego, una simulación de vuelo). El mundo físico desaparece por completo.

-

Realidad Aumentada (AR – Augmented Reality): Superposición de datos digitales sobre el mundo real, generalmente a través de una pantalla plana (como la cámara del móvil jugando a Pokémon GO o filtros de redes sociales). Es un formato de «mirar a través de», pero carece de comprensión profunda del entorno.

-

Realidad Mixta (MR – Mixed Reality): La fusión avanzada. Los objetos digitales no solo se superponen, sino que interactúan con el mundo físico. Si lanzas una pelota virtual, esta rebota en tu sofá real y rueda bajo tu mesa física.

-

Computación Espacial: Es la aplicación práctica y holística de la Realidad Mixta enfocada en la productividad, el sistema operativo y la interacción diaria. Significa que el ordenador (la CPU, la interfaz, los datos) sale de la pantalla y ocupa tu habitación. Las aplicaciones conviven contigo, entienden la iluminación de tu oficina, proyectan sombras sobre tu escritorio y permanecen ancladas espacialmente donde las dejaste, incluso si sales de la sala y vuelves al día siguiente.

1.2 El Paradigma de la Persistencia y la Conciencia Espacial

Lo que hace que el desarrollo para Apple Vision Pro sea revolucionario en 2026 es la conciencia del entorno (Environmental Awareness).

Cuando programas una aplicación tradicional, asumes que tu lienzo es un rectángulo negro de dimensiones fijas (1920×1080, por ejemplo). En la computación espacial, tu lienzo es infinito y dinámico. El sistema operativo utiliza el escáner LiDAR y las cámaras infrarrojas para crear una malla topográfica 3D (Mesh) invisible de la habitación del usuario en tiempo real.

Como desarrollador, ya no solo diseñas un botón; diseñas un botón que reacciona a la luz del sol que entra por la ventana del usuario en ese momento exacto. Esta fusión de renderizado físico (Physically Based Rendering o PBR) es lo que engaña al cerebro humano haciéndole creer que el objeto digital es real.

Capítulo 2: Anatomía del Ecosistema Apple (Hardware y Sensores)

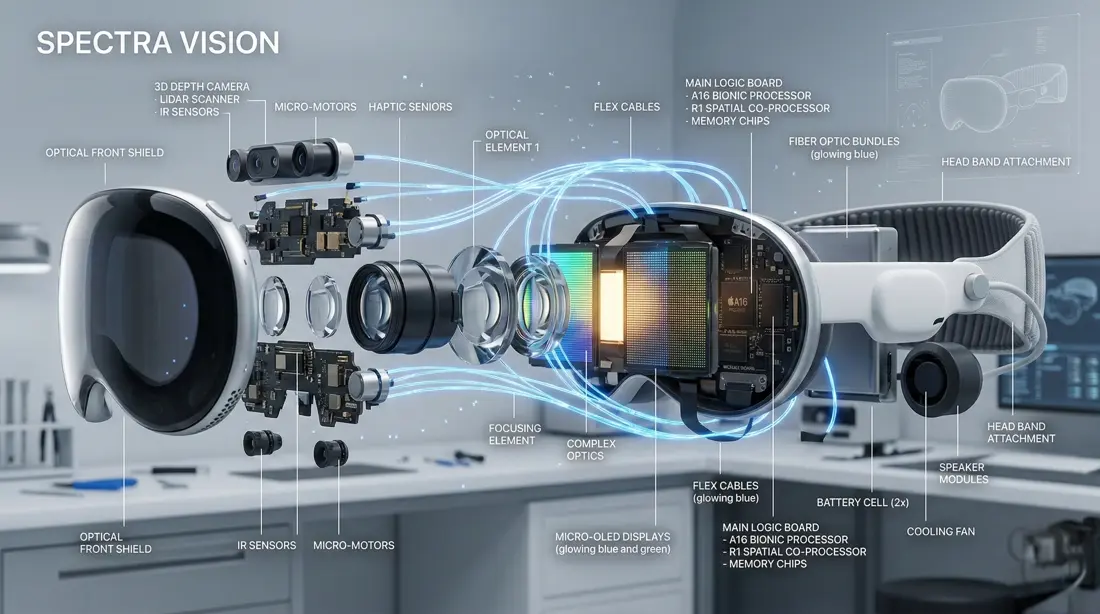

No puedes diseñar un buen software si no entiendes los límites y las capacidades del hardware que lo ejecuta. El Apple Vision Pro no es un simple monitor atado a la cabeza; es un superordenador empacado en aluminio y cristal, impulsado por una arquitectura de doble chip que ha marcado el estándar de la industria.

2.1 La Arquitectura de Doble Chip (M-Series y R-Series)

El mayor problema de los visores de realidad mixta anteriores a 2024 era el «Motion Sickness» (mareo inducido por movimiento). Si mueves la cabeza y el mundo digital tarda en actualizarse, tu cerebro detecta la discrepancia entre el oído interno y la vista, provocando náuseas. Apple solucionó esto separando las tareas.

-

El Chip M (Cerebro Lógico): (Derivado de los Mac). Se encarga del procesamiento computacional puro: ejecutar el sistema operativo visionOS, compilar gráficos, mantener la lógica de las aplicaciones (Swift/Unity) y gestionar la memoria. Es la fuerza bruta.

-

El Chip R (Cerebro Sensorial): Este coprocesador es la verdadera magia de la computación espacial. Su único propósito es procesar en tiempo real los datos que entran de las 12 cámaras, los 5 sensores y los 6 micrófonos. Logra una latencia fotón-a-fotón (desde que la luz entra en la cámara hasta que sale por la pantalla) de apenas 12 milisegundos, que es más rápido que el parpadeo de un ojo humano.

Implicación para el desarrollador: Esta división significa que tus aplicaciones pueden consumir recursos de CPU (Chip M) sin afectar críticamente a la fluidez del passthrough (ver el mundo real), lo que garantiza una experiencia base siempre segura y libre de mareos para el usuario.

2.2 Displays Micro-OLED: El Fin del Efecto «Puerta de Pantalla»

Para que la interfaz de usuario (UI) espacial sea legible —especialmente el texto corporativo, celdas de Excel o líneas de código—, la densidad de píxeles debe ser extrema.

El Vision Pro utiliza pantallas Micro-OLED del tamaño de un sello postal, empacando más de 23 millones de píxeles (más resolución que una televisión 4K para cada ojo). En 2026, esto significa que los diseñadores UI ya no tienen que usar fuentes gigantes y en negrita para compensar pantallas de baja resolución. Puedes diseñar con la misma precisión tipográfica que en un monitor Retina de un MacBook, sabiendo que el usuario podrá leer textos pequeños en ventanas flotantes situadas a tres metros de distancia virtual.

2.3 Seguimiento Ocular y LiDAR: El Nuevo «Ratón»

La interacción de hardware dicta la interfaz de software. En el ecosistema de Apple, tus ojos son el cursor y tus dedos son el clic.

-

Eye Tracking (Rastreo Ocular): Un anillo de LEDs infrarrojos invisibles ilumina el ojo del usuario, y cámaras de alta velocidad rastrean la posición exacta de la fóvea (el centro de la pupila). El sistema sabe exactamente qué botón estás mirando antes siquiera de que muevas la mano.

-

Escáner LiDAR: Mapea el entorno a la velocidad de la luz, creando un mapa de profundidad. Esto permite a los desarrolladores colocar objetos digitales detrás de objetos reales (Oclusión) sin esfuerzo computacional adicional de su parte, ya que visionOS lo gestiona a nivel de sistema.

Capítulo 3: visionOS - Desgranando el Sistema Operativo Tridimensional

Si iOS revolucionó la interacción táctil en 2007, visionOS ha hecho lo mismo para la interacción espacial. Construido sobre las fundaciones arquitectónicas de macOS e iOS, visionOS es un sistema operativo «Real-Time» diseñado para minimizar la latencia y maximizar la convivencia de aplicaciones.

Entender visionOS significa comprender sus tres bloques de construcción fundamentales: Ventanas, Volúmenes y Espacios Inmersivos.

3.1 Windows (Ventanas 2D en Espacio 3D)

La forma más básica de una aplicación en visionOS es una «Ventana» (Window). Visualmente, se asemejan a los paneles de iPadOS, pero están construidas con un material translúcido especial llamado Glass (Cristal).

-

Características de Diseño: El material Glass no es solo un color estático; reacciona a la luz ambiental de la habitación física del usuario. Si el usuario está en una sala oscura, la ventana se oscurece; si hay una lámpara fuerte a la derecha, la ventana reflejará esa luz.

-

Desarrollo 2026: Para los desarrolladores que migran apps existentes de iOS o iPadOS, el sistema operativo envuelve automáticamente la app plana en una de estas ventanas. Sin embargo, el buen diseño en 2026 exige no quedarse ahí, sino aprovechar el Z-axis (profundidad) para sacar elementos fuera del plano principal.

3.2 Volumes (Volúmenes 3D)

Aquí es donde la computación espacial empieza a cobrar sentido. Un Volumen es una «caja» delimitada (Bounding Box) en el espacio tridimensional dentro de la cual puedes colocar modelos 3D interactivos, escenas de RealityKit o componentes de SwiftUI.

-

Caso de Uso: Imagina una aplicación de anatomía médica. La interfaz de usuario (menús, textos explicativos) vive en una Ventana plana a la izquierda, mientras que a la derecha, el usuario tiene un Volumen con un modelo 3D fotorrealista de un corazón humano latiendo, el cual puede agarrar, rotar y observar desde cualquier ángulo.

-

Convivencia: Los Volúmenes viven en el «Espacio Compartido» (Shared Space). Esto significa que el usuario puede tener tu Volumen 3D del corazón al lado de su ventana de navegador Safari y su reproductor de Apple Music, todo flotando en su salón.

3.3 Immersive Spaces (Espacios Inmersivos)

Cuando tu aplicación necesita toda la atención del usuario, recurres a los Espacios Inmersivos. Al activar un Immersive Space, visionOS oculta todas las demás aplicaciones (Safari, Mail, etc.) y te cede el control total del campo visual.

Existen tres grados de inmersión:

-

Mixed (Mixto): Los objetos 3D de tu app se colocan por toda la habitación real del usuario, interactuando con las paredes y los muebles.

-

Progressive (Progresivo): El usuario gira la «Digital Crown» del visor para introducir un «portal» virtual (ej. un paisaje de montaña) que va tapando poco a poco su habitación real, pudiendo ajustar el nivel de aislamiento.

-

Full (Total): La habitación real desaparece por completo (modo VR clásico). Ideal para simuladores de entrenamiento, juegos narrativos intensos o experiencias de meditación profundas.

3.4 El Paradigma de Interacción: «Look and Tap»

En visionOS, la regla de oro del diseño interactivo es: «Tus ojos apuntan, tus manos actúan».

A diferencia de Meta Quest u otros visores que dependen de mandos con láseres virtuales, Apple ha estandarizado el Pinch (Pellizco) indirecto.

-

El usuario mira un botón (este se ilumina sutilmente gracias al «Hover effect» automático del sistema).

-

El usuario junta el dedo índice y el pulgar, sin importar dónde tenga la mano (puede estar descansando sobre sus piernas o en el reposabrazos).

-

Las cámaras apuntando hacia abajo detectan el pellizco y ejecutan el clic.

Como desarrollador web o de software, esto requiere un rediseño radical de los «Call to Action» (CTA). Los botones no pueden estar muy juntos, y los elementos interactivos no pueden ser minúsculos, ya que la precisión del ojo humano (que tiene microsacudidas naturales) no es tan milimétrica como la punta de un ratón de ordenador.

Capítulo 4: Principios Fundamentales de Diseño UX/UI para Entornos Espaciales

Diseñar para la computación espacial requiere desaprender vicios adquiridos durante décadas de diseño web y móvil. En 2026, el diseño UX/UI espacial no consiste en hacer que las cosas floten; consiste en respetar la fisiología humana. El usuario ya no sostiene un dispositivo; el dispositivo envuelve sus sentidos.

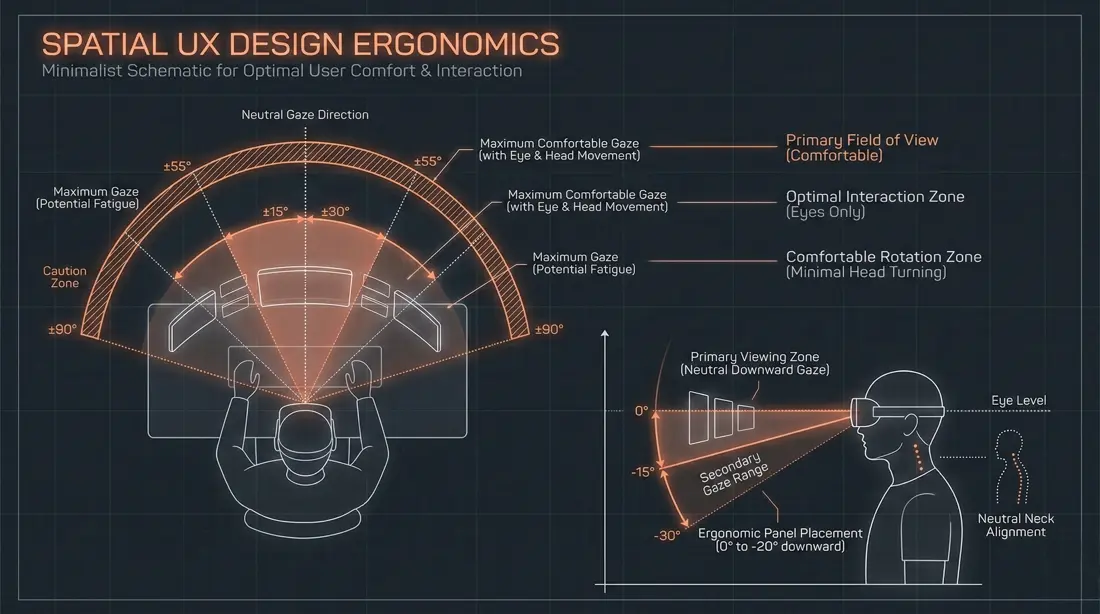

4.1 La Ergonomía del Cuello y el Campo de Visión (FOV)

En el diseño tradicional, situamos la información más importante en la parte superior de la pantalla (el clásico menú de navegación). En visionOS, esto es un error crítico.

-

El centro es el rey: El campo de visión humano en un visor de realidad mixta tiene un «Sweet Spot» (punto dulce). La información primaria debe estar directamente frente a los ojos del usuario.

-

Evita el dolor cervical: Los humanos estamos diseñados para mirar cómodamente hacia abajo (hasta 15-20 grados) durante largos periodos (piensa en cómo lees un libro). Sin embargo, mirar hacia arriba fatiga los músculos del cuello rápidamente. Por lo tanto, tu interfaz secundaria debe expandirse hacia abajo o hacia los lados en un arco curvo, nunca hacia el techo.

4.2 La Regla de los Puntos de Impacto (Hit Targets) para el Rastreo Ocular

Como mencionamos en el capítulo anterior, en 2026 el ratón es el ojo humano. Pero los ojos no son cursores estáticos; realizan microsacudidas constantes (movimientos sacádicos) para mantener el enfoque.

Si diseñas un botón minúsculo (como los clásicos iconos de 16×16 píxeles de una web antigua), el sistema de rastreo ocular del Vision Pro no sabrá con certeza si el usuario está mirando ese botón o el enlace que hay un milímetro más abajo.

-

El estándar de 2026: Apple exige que los elementos interactivos (botones, enlaces, menús) tengan un área de impacto (Hit Target) mínima de 60×60 puntos espaciales.

-

Separación: Además, debe haber un espaciado generoso (padding) entre botones. Si tienes una fila de iconos, sepáralos lo suficiente para que la intención de la mirada sea inconfundible.

4.3 Profundidad (Eje Z) y Jerarquía Visual

En una pantalla plana, usamos sombras (Drop Shadows) y opacidad para simular que un elemento está por encima de otro. En la computación espacial, la profundidad es real.

-

No abuses del 3D: El hecho de que puedas hacer todo tridimensional no significa que debas hacerlo. Leer texto en un bloque 3D rotando es mareante. El texto (tipografía) debe permanecer siempre en paneles planos bidimensionales (ventanas) orientados hacia el usuario (Billboarding).

-

Profundidad como jerarquía: Usa el Eje Z para indicar importancia. Si aparece un pop-up modal (una alerta de error o confirmación), no la hagas simplemente más grande; muévela físicamente unos centímetros más cerca del usuario en el espacio 3D, empujando la ventana principal hacia atrás y desenfocándola sutilmente (Efecto Dimming).

4.4 Materiales y «Glassmorphism» Funcional

El diseño de Apple para visionOS se basa en un material llamado Glass (Cristal). No es una elección puramente estética; es una necesidad funcional. Dado que la ventana flota en el mundo real del usuario (que puede ser una habitación blanca y brillante o un salón oscuro), usar colores sólidos opacos (como un fondo #FFFFFF puro o #000000) crea un parche visual agresivo que bloquea la visión periférica y rompe la inmersión.

El material Glass adapta dinámicamente su contraste y luminosidad. Deja pasar la luz del mundo real, garantizando que el texto (que automáticamente cambia de blanco a negro según la iluminación posterior) sea siempre legible, sin aislar al usuario de su entorno físico.

Capítulo 5: El Stack de Desarrollo en 2026: Swift, RealityKit, ARKit y Unity

Si estás decidido a programar para este ecosistema, necesitas conocer las herramientas de construcción. En 2026, el ecosistema se ha polarizado en dos grandes vertientes: el desarrollo nativo (el «Apple Way») y el desarrollo multiplataforma de motores gráficos.

5.1 El Enfoque Nativo: SwiftUI y RealityKit

Para el 80% de las aplicaciones corporativas, de productividad, utilidades y consumo multimedia, el desarrollo nativo es obligatorio. Garantiza el menor consumo de batería, la máxima fluidez y la integración perfecta con la estética del sistema operativo.

-

SwiftUI: Es el framework declarativo de Apple para construir la interfaz. Si ya sabes hacer apps para iOS con SwiftUI, ya sabes el 70% de visionOS. Apple ha añadido modificadores espaciales específicos, como

.windowStyle(.volumetric)para crear volúmenes 3D, o.hoverEffect()para que los botones reaccionen a la mirada. -

RealityKit: Es el motor de renderizado 3D propietario de Apple, diseñado específicamente para la realidad mixta. Maneja la física, las colisiones, la iluminación basada en físicas (PBR) y las animaciones de los modelos 3D que inyectas en tu app.

-

Reality Composer Pro: Esta es la herramienta estrella en 2026. Es un editor visual integrado en Xcode que permite a desarrolladores y artistas técnicos componer escenas 3D, configurar materiales (mediante Shader Graphs visuales sin tocar código complejo) y añadir audio espacial antes de importarlo a la aplicación en Swift.

-

ARKit: Mientras RealityKit dibuja el 3D, ARKit entiende el mundo real. Es la librería que procesa la malla de la habitación (Room Tracking), detecta planos (suelos, mesas) y, lo más importante, proporciona el Hand Tracking (seguimiento de las articulaciones de las manos) para crear interacciones personalizadas más allá del pellizco estándar.

5.2 El Enfoque de Motor Gráfico: Unity (PolySpatial)

Si tu objetivo es crear un videojuego inmersivo, un simulador de físicas complejas o un «Gemelo Digital» (Digital Twin) industrial que debe compartirse entre Meta Quest, PC y Vision Pro, la vía nativa es limitante.

En 2026, Unity es el socio oficial de Apple para el desarrollo de terceros. A través de la tecnología PolySpatial, Unity permite que los juegos y apps 3D complejas se ejecuten dentro del entorno compartido de visionOS, traduciendo los materiales y shaders de Unity al lenguaje de renderizado nativo de Apple. Esto evita que tu app «secuestre» el dispositivo, permitiendo al usuario jugar a tu juego en Unity mientras tiene la ventana nativa de Mensajes abierta al lado.

5.3 ¿Y el Desarrollo Web (WebXR)?

El navegador Safari en visionOS es extremadamente potente y, a principios de 2026, el estándar WebXR está soportado de forma sólida. Si tienes una tienda online de muebles (ej. Shopify), puedes usar librerías como Three.js o Model-Viewer para que, desde la propia web, el usuario haga clic en un sofá y este «salga» del navegador y se coloque en el suelo de su salón en 3D. Es una vía excelente para el comercio electrónico, aunque no ofrece el rendimiento necesario para aplicaciones complejas.

Capítulo 6: Errores Comunes al Diseñar para la Computación Espacial (y Cómo Evitarlos)

La transición a la computación espacial está plagada de cadáveres de aplicaciones mal diseñadas que causaban fatiga o mareos. Estos son los tres pecados capitales en 2026:

6.1 Pecado 1: El Síndrome del «Brazo de Gorila» (Gorilla Arm)

Este fue el gran error de la VR temprana. Obligar al usuario a levantar físicamente el brazo y mantenerlo suspendido en el aire para «tocar» hologramas causa una fatiga muscular extrema en pocos minutos.

-

La solución: Usa la interacción indirecta. El usuario debe poder interactuar con tu app mirando el elemento y pellizcando con las manos descansando en su regazo. La interacción táctil directa (tocar el holograma con el dedo) solo debe usarse para interfaces muy cercanas e inmersivas (como tocar el teclado virtual o girar una rueda en un modelo 3D cercano).

6.2 Pecado 2: Secuestrar el Entorno del Usuario sin Motivo

Muchos desarrolladores novatos lanzan su app y automáticamente la abren en un Full Immersive Space (fondo negro o un paisaje virtual cerrado), aislando al usuario de su salón.

-

La solución: Las apps deben abrirse siempre en una ventana compartida (Shared Space) por defecto. El usuario es el dueño de su entorno. Si tienes un modo inmersivo (ej. un cine virtual), debe ser una opción que el usuario active voluntariamente mediante un botón claro.

6.3 Pecado 3: Locomoción Artificial (Mover al usuario)

Si mueves la cámara del usuario en el mundo virtual sin que él se mueva en el mundo físico (por ejemplo, usando un joystick para «caminar» por una casa 3D), provocarás náuseas (Motion Sickness) en el 50% de la población.

-

La solución: Si el usuario necesita desplazarse grandes distancias en tu app inmersiva, usa el teletransporte (Fade to Black -> Aparecer en la nueva ubicación) o diseña la experiencia para que el contenido venga hacia el usuario, en lugar de que el usuario vaya hacia el contenido.

5.3 Despliegue en el Edge

Cuando despliegas esto (en Vercel, AWS o Docker optimizado), el servidor no tiene que «pensar» para enviar el primer byte. Envía el HTML estático pre-calculado. El usuario ve la web al instante. Luego, el servidor procesa solo la parte personalizada. Resultado: Core Web Vitals (LCP/FCP) perfectos, experiencia personalizada.

Capítulo 7: Casos de Uso Reales, Productividad y Adopción Empresarial

Para 2026, el Apple Vision Pro y sus competidores directos han trascendido el nicho del entretenimiento. El Retorno de Inversión (ROI) se está demostrando en el sector B2B (Business to Business).

7.1 Monitor Infinito para Programadores y Analistas (Mac Virtual Display)

El caso de uso número uno en productividad es el reemplazo del hardware físico. Un analista de datos o un programador ya no necesita comprar tres monitores 4K y ocupar una gran mesa. Al conectar un MacBook al Vision Pro, la pantalla del portátil se proyecta como un monitor virtual gigante, nítido y sin bordes en el espacio, acompañado de ventanas nativas de visionOS (Slack, Safari, Música) flotando alrededor. Es la oficina portátil definitiva.

7.2 Formación Médica y Simulación Industrial

Aprender anatomía o practicar cirugía en 2D (libros o pantallas) es ineficiente. Las aplicaciones de salud en 2026 permiten a estudiantes de medicina diseccionar modelos anatómicos volumétricos a escala real con una precisión submilimétrica. En la industria aeronáutica y automotriz, los ingenieros visualizan «Gemelos Digitales» (Digital Twins) de motores en tamaño real sobre la mesa de la sala de reuniones, pudiendo revisar el ensamblaje capa por capa antes de fabricar un solo tornillo real.

7.3 Colaboración Remota y las «Spatial Personas»

Las videollamadas planas están siendo reemplazadas por espacios de colaboración reales. En 2026, las Spatial Personas de Apple escanean el rostro del usuario y lo reconstruyen en 3D en tiempo real. Si tienes una reunión con tres colegas de diferentes países, no los ves en una cuadrícula en tu pantalla. Aparecen sentados alrededor de tu mesa física real, interactuando con el mismo modelo 3D de un producto. La dirección del audio (Audio Espacial) hace que escuches sus voces proviniendo exactamente del lugar físico donde está sentado su avatar, recreando la dinámica psicológica de una reunión presencial.

Conclusión: Preparando tu Carrera para la Década Espacial

La Computación Espacial en 2026 es exactamente lo que fue el desarrollo móvil en 2010. Aquellos que entendieron que un smartphone no era un ordenador en miniatura, sino un paradigma completamente nuevo (con GPS, cámara, acelerómetro y multitoque), fueron los que construyeron imperios como Uber, Instagram o WhatsApp.

Diseñar para Apple Vision Pro y el ecosistema de visionOS no consiste en portar tu página web a una pantalla flotante. Consiste en repensar cómo los humanos procesan la información. Consiste en usar la profundidad para crear jerarquía visual, la iluminación dinámica para crear realismo, y el rastreo ocular para crear interfaces que parecen leer la mente del usuario.

Si eres diseñador, tu próximo paso es aprender herramientas de prototipado 3D (como Spline o Reality Composer). Si eres desarrollador, es el momento de dominar Swift, abrazar la lógica de SwiftUI y desempolvar tus conocimientos de matemáticas vectoriales y matrices 3D.

La ventana plana ha cumplido su función durante cuarenta años. Ha llegado el momento de dar un paso al frente y entrar en el espacio. La década de la computación espacial ha comenzado, y la demanda de profesionales capaces de construir este nuevo mundo digital no hará más que crecer.

💬 Preguntas y Respuestas (FAQ)

1. ¿Qué diferencia hay entre Computación Espacial, Realidad Virtual (VR) y Realidad Aumentada (AR)?

1. ¿Qué diferencia hay entre Computación Espacial, Realidad Virtual (VR) y Realidad Aumentada (AR)?

La Computación Espacial es el término paraguas que engloba la interacción del usuario con la tecnología en un entorno tridimensional. La VR (Realidad Virtual) aísla completamente al usuario en un mundo digital cerrado. La AR (Realidad Aumentada) superpone elementos digitales básicos sobre el mundo real (como los filtros de smartphone). La Computación Espacial, impulsada por dispositivos de realidad mixta, fusiona ambas: el contenido digital interactúa físicamente con tu entorno real, respondiendo a la iluminación, proyectando sombras y anclándose a la topografía de tu habitación.

2. ¿Es necesario aprender a programar en Swift para desarrollar en Apple Vision Pro?

2. ¿Es necesario aprender a programar en Swift para desarrollar en Apple Vision Pro?

Aunque es altamente recomendable por la optimización nativa, no es la única vía. A principios de 2026, el ecosistema de Apple prioriza Swift, SwiftUI y RealityKit para crear experiencias fluidas y eficientes en visionOS. Sin embargo, los desarrolladores que vienen de la industria de los videojuegos pueden utilizar motores como Unity, que cuentan con integraciones profundas y oficiales (PolySpatial) para compilar proyectos complejos de realidad mixta directamente hacia el ecosistema de Apple.

3. ¿Cómo ha evolucionado el peso y la ergonomía de los visores para 2026?

3. ¿Cómo ha evolucionado el peso y la ergonomía de los visores para 2026?

El primer Apple Vision Pro (2024) sentó las bases tecnológicas, pero fue criticado por su peso frontal. En 2026, la industria ha iterado hacia dispositivos significativamente más ligeros y balanceados, separando componentes pesados de procesamiento o utilizando materiales de aleación más avanzados. Esta evolución ergonómica es fundamental porque dicta el tiempo que un usuario promedio puede interactuar con tus aplicaciones de manera cómoda.

4. ¿Qué es el "Passthrough" de alta fidelidad y por qué es crucial en visionOS?

4. ¿Qué es el "Passthrough" de alta fidelidad y por qué es crucial en visionOS?

El Passthrough es la tecnología que utiliza las cámaras externas del visor para mostrarte el mundo real en tiempo real a través de las pantallas internas. En visionOS, este sistema tiene una latencia casi nula (milisegundos) y alta resolución. Es crucial porque es la base de la computación espacial: evita el mareo por movimiento (motion sickness) y permite que los elementos digitales (ventanas de apps, modelos 3D) parezcan estar físicamente presentes en tu salón u oficina.

5. ¿Cómo se adaptan las aplicaciones tradicionales de iOS o iPadOS a la computación espacial?

5. ¿Cómo se adaptan las aplicaciones tradicionales de iOS o iPadOS a la computación espacial?

visionOS cuenta con compatibilidad nativa para la inmensa mayoría de apps de iOS y iPadOS. Estas se ejecutan en «ventanas planas» flotantes dentro del espacio 3D del usuario. Sin embargo, simplemente portar una app no aprovecha el potencial del dispositivo. Las aplicaciones verdaderamente espaciales añaden «Volúmenes» (elementos 3D limitados por una caja) o «Espacios Inmersivos» (entornos que rodean parcial o totalmente al usuario), rediseñando la interfaz de usuario para interacciones con la mirada y pellizcos.

6. ¿Cuáles son los mayores desafíos de UX/UI al diseñar para entornos tridimensionales?

6. ¿Cuáles son los mayores desafíos de UX/UI al diseñar para entornos tridimensionales?

El mayor desafío es abandonar la mentalidad de las pantallas delimitadas. El diseñador debe considerar la ergonomía física: el usuario no debe forzar el cuello para ver el contenido (debe ubicarse en el campo de visión natural) ni fatigar los brazos. La jerarquía visual se vuelve literal mediante la profundidad (Z-axis), el contraste con el entorno físico cambiante y el tamaño de los elementos interactivos, que deben ser lo suficientemente grandes para ser seleccionados cómodamente con la mirada.

7. ¿Qué impacto tiene la computación espacial en la productividad y el trabajo remoto en 2026?

7. ¿Qué impacto tiene la computación espacial en la productividad y el trabajo remoto en 2026?

El impacto ha sido transformacional. En lugar de estar limitados a uno o dos monitores físicos, los trabajadores en 2026 despliegan lienzos digitales infinitos. Permite tener múltiples ventanas de gran tamaño ancladas en diferentes partes de una habitación. Además, la colaboración mediante avatares fotorrealistas (Personas) en espacios de trabajo compartidos ha reducido la «fatiga de Zoom», aportando un sentido de presencia y escala que las videoconferencias planas no pueden igualar.

8. ¿Cómo gestiona visionOS el seguimiento ocular y los gestos con las manos para la interacción?

8. ¿Cómo gestiona visionOS el seguimiento ocular y los gestos con las manos para la interacción?

A diferencia de los visores VR tradicionales que requieren mandos físicos, visionOS utiliza un paradigma de «Mirar y Tocar». Un sofisticado anillo de LEDs infrarrojos y cámaras internas rastrea exactamente hacia dónde mira el usuario, utilizando los ojos como un cursor hiperpreciso. La selección se realiza con un microgesto (pellizcar con los dedos índice y pulgar) que las cámaras externas detectan incluso si las manos descansan sobre las piernas.

9. ¿Qué son los "Volúmenes" y los "Espacios Compartidos" en el desarrollo de visionOS?

9. ¿Qué son los "Volúmenes" y los "Espacios Compartidos" en el desarrollo de visionOS?

En visionOS, una aplicación puede presentarse de tres formas. Las «Ventanas» son paneles 2D clásicos. Los «Volúmenes» son contenedores 3D que pueden verse desde todos los ángulos y conviven con otras apps (Espacio Compartido). Finalmente, los «Espacios Inmersivos» ocultan otras aplicaciones y pueden reemplazar parcial o totalmente el entorno físico del usuario para ofrecer una experiencia dedicada e ininterrumpida.

10. ¿Es la computación espacial el fin de los monitores físicos tradicionales?

10. ¿Es la computación espacial el fin de los monitores físicos tradicionales?

No los reemplazará de la noche a la mañana, del mismo modo que el iPad no reemplazó completamente al Mac. Sin embargo, en 2026, la computación espacial se consolida como la alternativa superior para trabajos que requieren alta concentración, visualización de datos complejos, diseño 3D y simulaciones de formación. Para muchas tareas basadas en el conocimiento, el monitor físico empieza a verse como una limitación impuesta por el hardware del pasado.