Introducción: Por qué el SEO Técnico en 2025 es un Juego Diferente

El SEO técnico ha muerto. Larga vida al SEO técnico.

Esta frase, que resuena cada año, nunca ha sido más cierta que en 2025. Durante años, «técnico» significaba robots.txt, sitemaps y velocidad de página. Hoy, esa es la base sobre la que se construye el verdadero rascacielos.

En 2025, una auditoría SEO técnica no solo pregunta «¿Puede Google ver esta página?», sino que profundiza en:

- Contextualización para la IA: ¿Está mi contenido estructurado para que los modelos de lenguaje (como Gemini) lo entiendan, lo citen y lo usen para generar AI Overviews?

- Rendimiento Interactivo: Con Interaction to Next Paint (INP) reemplazando a FID, ¿es mi sitio realmente interactivo y fluido, o simplemente «carga rápido»?

- Seguridad y Confianza: ¿Es mi sitio una fortaleza digital que genera confianza (un pilar del E-E-A-T) o un colador de vulnerabilidades?

- Eficiencia de Rastreo: Con la web expandiéndose exponencialmente, ¿estoy optimizando mi presupuesto de rastreo para que Googlebot y

Google-Extended(el rastreador de IA) encuentren mi contenido más valioso primero?

Esta guía no es para principiantes. Es un manual de campo avanzado, paso a paso, diseñado para diagnosticar y solucionar los problemas técnicos que separan a los sitios web funcionales de los dominantes. Al final, tendrás un checklist exhaustivo para ejecutar tu propia auditoría forense.

Fase 0: Preparación y Arsenal de Herramientas

Antes de entrar en el quirófano, necesitas las herramientas adecuadas. Una auditoría avanzada no se puede hacer solo con una herramienta. Necesitamos una suite:

-

Google Search Console (GSC): Tu panel de control directo con Google. Indispensable para informes de indexación, Core Web Vitals (CWV) y usabilidad móvil.

-

Google Analytics 4 (GA4): Para cruzar datos de rendimiento con comportamiento de usuario.

-

Screaming Frog SEO Spider: El bisturí del auditor. Para rastrear el sitio como lo haría un bot, encontrando enlaces rotos, redirecciones, contenido duplicado y más. La versión de pago es obligatoria para sitios de más de 500 URLs.

-

Herramientas de Analítica de Logs (Screaming Frog Log File Analyser, Splunk, o ELK Stack): El nivel «dios» de la auditoría. Te permite ver exactamente qué está haciendo Googlebot en tu servidor, sin filtros.

-

PageSpeed Insights / GTmetrix / WebPageTest: Para análisis de rendimiento a nivel de página. PageSpeed es crucial ya que usa datos de CrUX (Chrome User Experience Report).

-

Google’s Rich Results Test & Schema Markup Validator: Para validar tus datos estructurados.

-

Chrome DevTools (Especialmente los paneles Lighthouse, Performance y Network): Para depuración en tiempo real.

-

Suite SEO (Ahrefs / Semrush): Útil para auditorías de sitio, análisis de backlinks (que pueden revelar problemas técnicos) y seguimiento de la competencia.

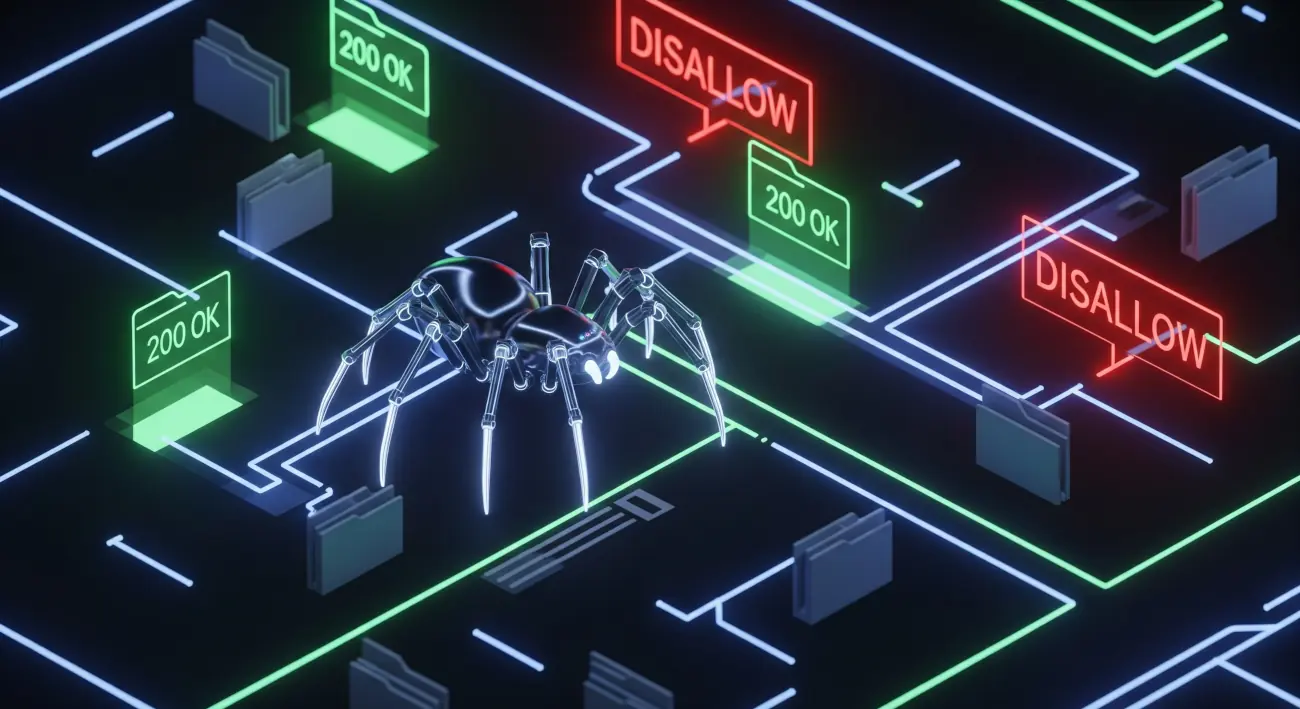

Fase 1: Rastreo, Indexación y Accesibilidad (La Fundación)

1.1. Análisis de robots.txt

Tu robots.txt es la primera puerta que Google toca.

- Revisión Estándar: Asegúrate de no estar bloqueando accidentalmente recursos críticos (CSS, JS) o secciones importantes del sitio.

- Auditoría Avanzada 2025:

- Control de IA: ¿Estás usando

Google-Extended? Si no quieres que tu contenido entrene a los modelos de IA de Google, debes bloquearlo explícitamente.User-agent: Google-ExtendedDisallow: / - Eficiencia: ¿Estás bloqueando URLs con parámetros de filtrado inútiles (

/productos?color=rojo&talla=m) que consumen el presupuesto de rastreo? UsaDisallow:para estos patrones si no se manejan conrel="canonical". - Sitemap: ¿Está tu sitemap (o índice de sitemaps) correctamente declarado al final del archivo?

Sitemap:

https://www.dominio.com/sitemap.xml

- Control de IA: ¿Estás usando

1.2. Meta Robots y X-Robots-Tag

Estas son las instrucciones a nivel de página.

- Revisión Estándar: Busca conflictos. Una página en el sitemap no puede tener un

noindex. Una página enrobots.txtno será rastreada, por lo que su metanoindexnunca será leída. - Auditoría Avanzada 2025:

- X-Robots-Tag: ¿Usas PDFs, imágenes o vídeos que no quieres indexar? No puedes poner una meta etiqueta en un PDF. Debes usar el

X-Robots-Tagen la cabecera HTTP. Revisa tus cabeceras de servidor para estos archivos. indexifembedded: ¿Tienes contenido (ej. un widget) incrustado en otras páginas con uniframey bloqueado connoindex? Si quieres que se indexe solo cuando está incrustado, usa la etiquetacontent="indexifembedded" />en la URL del widget.data-nosnippet: ¿Tienes texto en la página que no quieres que aparezca en los snippets de búsqueda (ej. avisos legales al inicio del artículo)? Enciérralo en un....

- X-Robots-Tag: ¿Usas PDFs, imágenes o vídeos que no quieres indexar? No puedes poner una meta etiqueta en un PDF. Debes usar el

1.3. Sitemaps XML

Tu mapa para Google.

- Revisión Estándar: ¿Está en formato XML válido? ¿Incluye solo URLs 200 (OK)? ¿Está actualizado?

- Auditoría Avanzada 2025:

- Sitemaps Dinámicos: Para sitios grandes, el sitemap debe generarse dinámicamente. ¿Se actualiza automáticamente cuando se publica, actualiza o elimina contenido?

: Esta es la etiqueta más importante. Debe reflejar la fecha real de última modificación. Falsearla erosiona la confianza de Google. Verifica que tu CMS actualice esta fecha correctamente.- Segmentación: No tengas un sitemap de 50,000 URLs. Divídelo por secciones (blog, productos, categorías) usando un índice de sitemaps. Facilita la depuración.

- Sitemaps de Vídeo e Imágenes: Si el vídeo y las imágenes son tu producto principal, crea sitemaps específicos para ellos.

1.4. Análisis de Logs (El Verdadero Nivel Avanzado)

Aquí es donde separamos a los profesionales de los amateurs. Los logs del servidor son la única fuente de verdad sobre el rastreo.

- Obtén los Logs: Pide a tu equipo de sistemas los logs de acceso de las últimas 2-4 semanas.

- Filtra por Googlebot: Aíslate a los User-Agents de Googlebot (y

Google-Extended). Verifica sus IPs con una búsqueda DNS inversa para asegurarte de que no sean bots falsos. - Analiza (Screaming Frog Log Analyser):

- ¿Qué rastrea Google? ¿Pasa el 80% de su tiempo en páginas de filtrado sin valor o en tus páginas de «money content»? Si es lo primero, tienes un problema de eficiencia.

- Códigos de Estado: ¿Cuántos 404, 301, 302, o 5xx está encontrando Googlebot? Cada error es presupuesto desperdiciado.

- Frecuencia de Rastreo vs.

lastmod: ¿Google rastrea tu blog a diario pero tu sitemap dice que se actualizó hace 6 meses? Inconsistencia. - Descubrimiento: ¿Googlebot rastrea URLs que no están en tu sitemap? ¿Por qué? Probablemente por enlaces internos o backlinks.

1.5. SEO para JavaScript (JS)

La mayoría de los sitios modernos dependen de JS.

- Revisión Estándar: ¿Es visible el contenido sin JS? (Usa una extensión para desactivar JS).

- Auditoría Avanzada 2025:

- Renderizado: Google rastrea en dos oleadas (HTML inicial, y luego renderizado de JS). Este segundo paso es caro. ¿Estás usando Server-Side Rendering (SSR) o Static Site Generation (SSG) para tu contenido crítico? Es la solución preferida.

- Dynamic Rendering: Si no puedes usar SSR, ¿estás sirviendo una versión HTML renderizada a los bots y la versión JS al cliente? Es una solución válida pero compleja de mantener.

- Enlaces: ¿Tus enlaces internos son

aconhref? Google puede no seguir enlaces basados enonClickde JS (). Rastrea tu sitio con Screaming Frog en modo "AJAX Rendering" y compara los resultados con el rastreo de texto.

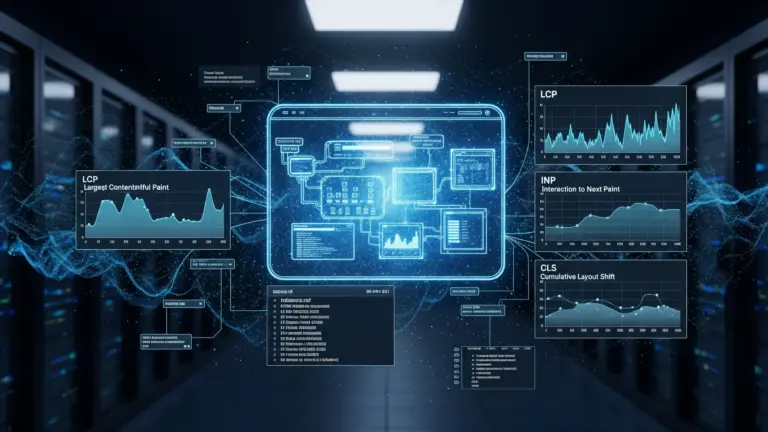

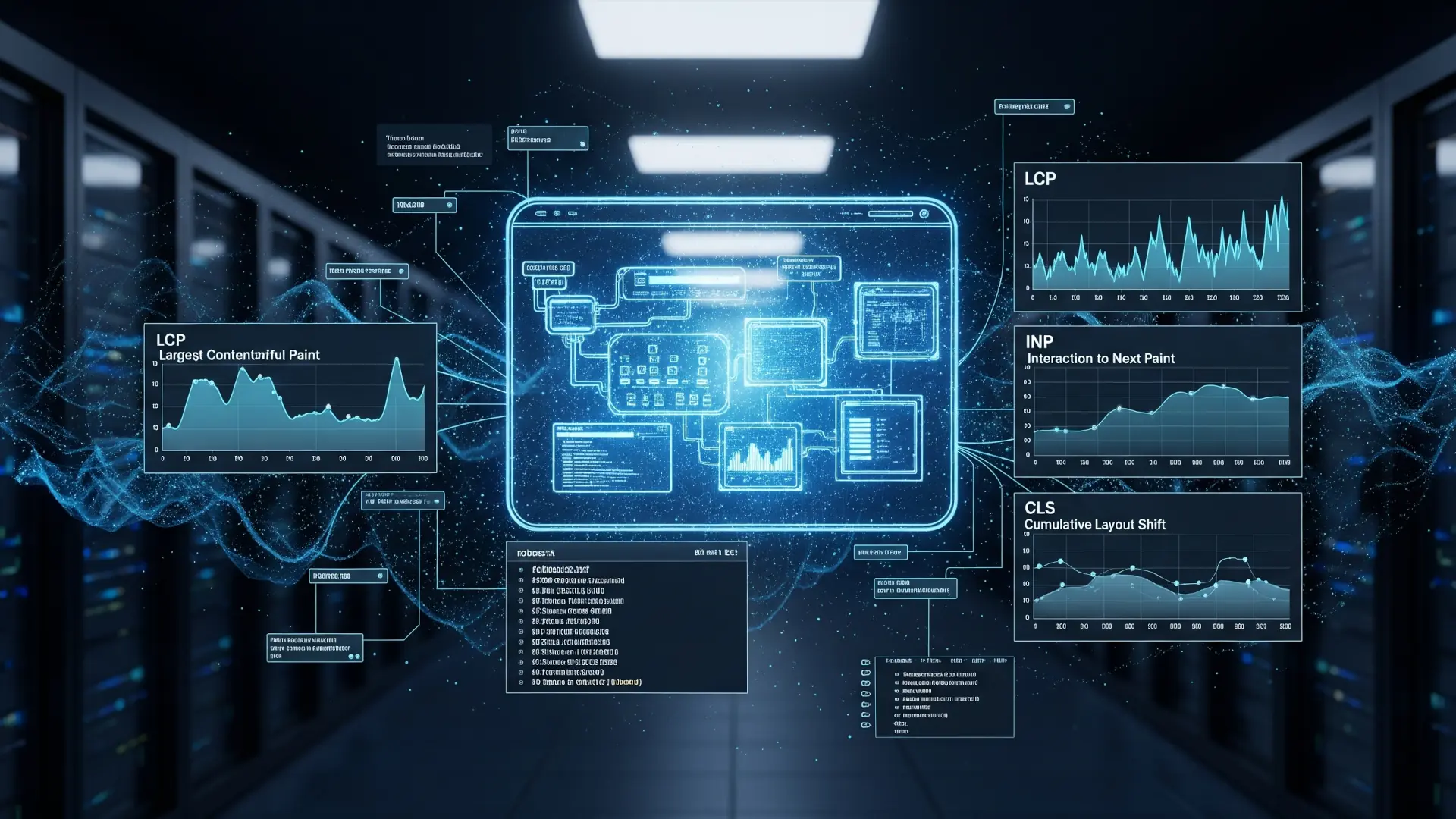

Fase 2: Rendimiento y Experiencia (Core Web Vitals 2025)

En 2025, la velocidad no es una característica, es la base de la experiencia.

2.1. El Nuevo Rey: Interaction to Next Paint (INP)

INP reemplazó a FID (First Input Delay) y es mucho más exigente. No mide solo el primer retraso, sino la latencia de todas las interacciones del usuario. Un INP «bueno» es de 200ms o menos.

-

Auditoría:

-

Datos de Campo (CrUX): Mira tu informe de GSC. ¿Estás fallando en INP?

-

Datos de Laboratorio: Abre Chrome DevTools > Performance. Graba un perfil de carga e interactúa con la página (clics en menús, acordeones, formularios). Observa la «Main Thread» (hilo principal).

-

-

Solución (Avanzada):

-

JS Pesado: El 90% de los problemas de INP son por JS bloqueando el hilo principal. ¿Tienes un

clickhandler que ejecuta 200ms de código? Eso es un INP de 200ms. -

Optimización de Tareas: Divide tareas largas de JS en tareas más pequeñas usando

scheduler.postTask()osetTimeout. -

content-visibility: auto;: Esta propiedad CSS le dice al navegador que omita el renderizado de contenido fuera de pantalla, liberando el hilo principal. -

Web Workers: Mueve cálculos de JS no relacionados con la UI (como procesar datos) a un «Web Worker» en un hilo separado.

-

2.2. Largest Contentful Paint (LCP)

El tiempo que tarda en cargarse el elemento más grande (generalmente una imagen o un bloque de texto).

-

Auditoría: PageSpeed Insights te dirá cuál es tu elemento LCP.

-

Solución:

-

Prioriza el LCP: ¿Es una imagen? Pre-cárgala.

. -

Optimiza la Imagen: ¿Está en formato

WebPoAVIF? ¿Está comprimida? ¿Se sirve desde un CDN? -

Bloqueo de Renderizado: ¿Tu CSS o JS bloquea la carga del LCP? Difiere todo lo no esencial.

-

2.3. Cumulative Layout Shift (CLS)

Estabilidad visual. ¿Los elementos saltan mientras la página carga?

-

Auditoría: PageSpeed Insights y GSC.

-

Solución:

-

Dimensiones: Siempre define

widthyheight(oaspect-ratio) en tus imágenes, vídeos e iframes.img {.

aspect-ratio: 16/9; } -

Espacio para Anuncios: Si usas anuncios, reserva su espacio con un

divde altura mínima (min-height). -

Fuentes (FOIT/FOUT): ¿La fuente web tarda en cargar y provoca un «salto» de texto? Usa

font-display:pero combínalo con pre-carga de fuentes o el uso de fuentes del sistema.

swap;

-

Fase 3: Arquitectura, Enlazado y Autoridad

La forma en que organizas tu contenido dicta cómo fluye la autoridad y qué considera Google importante.

3.1. Estructura y Profundidad de Clic

-

Auditoría: ¿Cuántos clics se necesitan para llegar desde la Home a tus páginas de «money content»? Usa Screaming Frog para ver la «Profundidad de Rastreo».

-

Solución: Todo lo importante debe estar a 3 clics o menos de la Home. Tu enlazado interno (menús, breadcrumbs, enlaces contextuales) debe reflejar esto. Una arquitectura plana es mejor que una profunda.

3.2. Enlaces Rotos y Cadenas de Redirección

-

Enlaces Rotos (404): Cada 404 interno es un callejón sin salida para el «link juice» y una mala experiencia. Encuéntralos con Screaming Frog y corrígelos (actualiza el enlace o redirige el 404 con un 301).

-

Redirecciones (301 vs. 302):

301es permanente,302es temporal. ¿Usas 302 para cambios permanentes? Estás perdiendo equidad de enlace. -

Cadenas de Redirección (Avanzado): ¿Tu página A redirige a B, que redirige a C? (A > B > C). Has desperdiciado presupuesto de rastreo y diluido la autoridad. Audita esto en Screaming Frog (Reports > Redirects > Redirect Chains) y aplana las cadenas (A > C).

3.3. Gestión de Contenido Duplicado y Canonización

El contenido duplicado es un asesino de la eficiencia.

-

Auditoría:

-

wwwvs. no-www,httpvs.httpsA. -

Parámetros de URL:

?utm_source=...,?color=.... -

Versiones de impresión (

?print=true).

-

-

Solución:

-

rel="canonical": La herramienta principal. Cada página debe tener una etiquetarel="canonical"auto-referenciada. En las páginas duplicadas (como las de parámetros), esta etiqueta debe apuntar a la URL «limpia» o principal. -

Parámetros en GSC: Si no puedes usar canonicals, usa la (antigua pero funcional) herramienta de Parámetros de URL en GSC para decirle a Google que ignore ciertos parámetros.

-

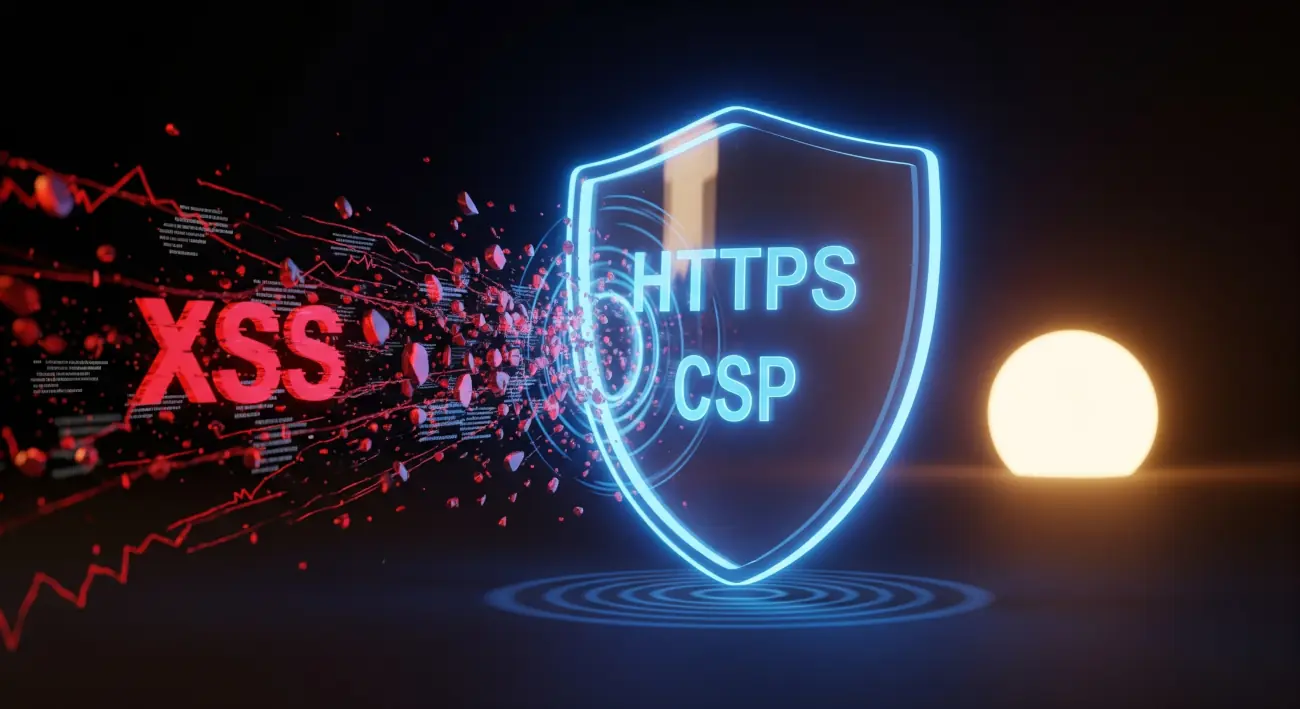

Fase 4: Seguridad, Confianza y E-E-A-T Técnico

La seguridad no es opcional. Un sitio inseguro no puede tener autoridad (E-E-A-T).

4.1. HTTPS y HSTS

-

HTTPS: En 2025, si no tienes HTTPS, estás fuera de juego.

-

Mixed Content: El problema más común. Tu página es HTTPS, pero cargas una imagen o un script desde

http://.... Esto rompe el candado. Usa Screaming Frog (Configuration > Spider > Crawl > «Crawl HTTP if HTTPS») para encontrar y arreglar esto. -

HSTS (HTTP Strict Transport Security): Nivel avanzado. Esta es una cabecera de servidor que le dice al navegador: «Durante los próximos 6 meses, solo comunícate conmigo a través de HTTPS, incluso si el usuario escribe

http://«. Previene ataques «man-in-the-middle».

4.2. Vulnerabilidades y Políticas de Seguridad

-

Content Security Policy (CSP): Una cabecera de seguridad avanzada que te permite crear una «lista blanca» de dominios desde los cuales se pueden cargar recursos (scripts, estilos, imágenes). Esto anula casi por completo los ataques de Cross-Site Scripting (XSS). Un XSS podría permitir a un atacante inyectar spam en tus páginas, destruyendo tu SEO.

-

Software Actualizado: ¿Tu CMS (WordPress, Magento) y tus plugins están actualizados? Las vulnerabilidades conocidas son la principal puerta de entrada para hacks de SEO (inyección de spam japonés, etc.).

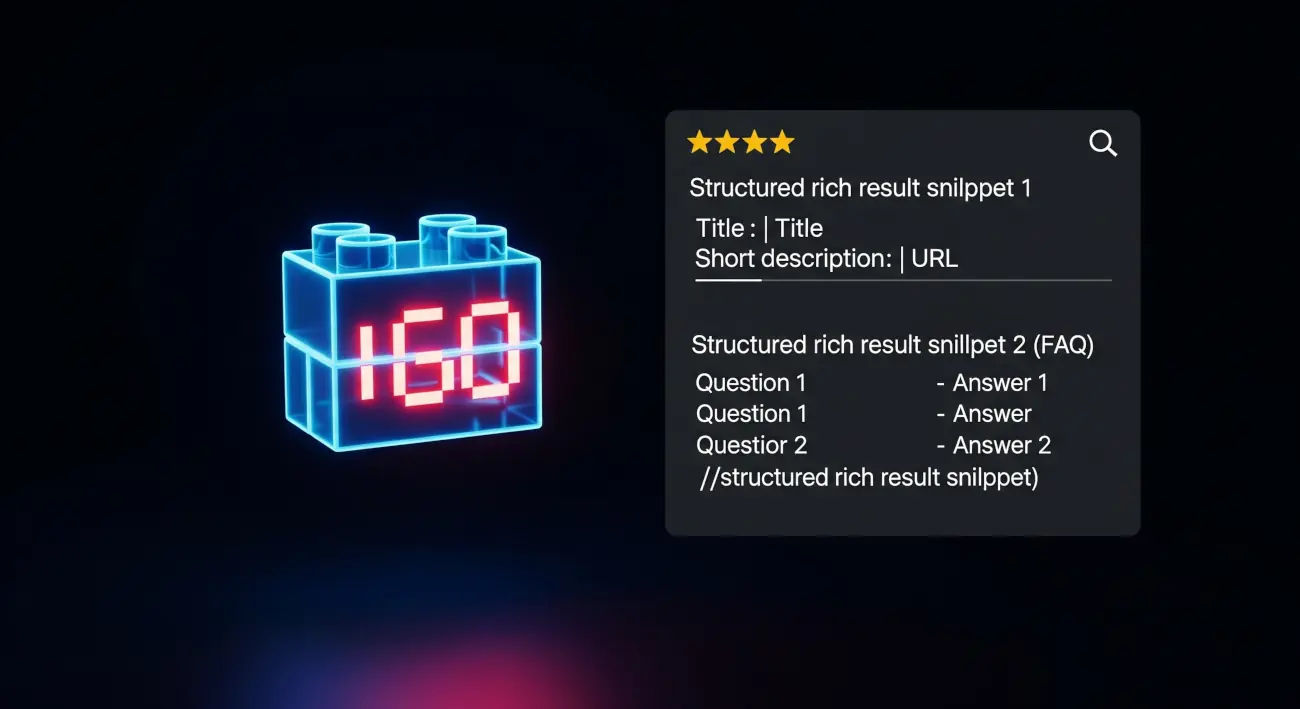

Fase 5: Datos Estructurados (El Lenguaje de la IA)

En 2025, los datos estructurados (Schema.org) no son solo para estrellas de valoración. Son el manual de instrucciones que le das a Gemini para que entienda tu contenido y lo use en AI Overviews.

- Auditoría:

- Validación: ¿Tu Schema es válido? Usa el «Rich Results Test» de Google.

- Cobertura: ¿Estás usando el Schema adecuado?

Article/NewsArticlepara posts.Product(conOffers,Review,AggregateRating) para e-commerce.FAQPagepara preguntas y respuestas.HowTopara guías.VideoObjectpara vídeos.OrganizationyPersonpara E-E-A-T.

- Implementación (Avanzada):

- JSON-LD: Es el formato preferido. Es un script en el

<head>o<body>que está separado de tu HTML, lo que lo hace más limpio. - Anidamiento: No tengas Schemas separados. Anídalos. Un

Articledebe tener unauthorque sea de tipoPerson, que a su vez sea parte de unaOrganization. Así es como creas un «grafo de conocimiento» de tu sitio. - Ejemplo de JSON-LD anidado:

- JSON-LD: Es el formato preferido. Es un script en el

{

«@context»: «https://schema.org»,

«@type»: «Article»,

«mainEntityOfPage»: {

«@type»: «WebPage»,

«@id»: «https://www.dominio.com/articulo.html»

},

«headline»: «Tu Gran Título»,

«author»: {

«@type»: «Person»,

«name»: «Nombre del Autor»

},

«publisher»: {

«@type»: «Organization»,

«name»: «Nombre de tu Sitio»,

«logo»: {

«@type»: «ImageObject»,

«url»: «https://www.dominio.com/logo.png»

}

}

}

Fase 6: SEO Internacional y Móvil

6.1. Mobile-First (Mobile-Only)

Google ya no indexa «versiones de escritorio». Indexa la versión móvil.

-

Auditoría:

-

Paridad de Contenido: ¿Tu versión móvil tiene exactamente el mismo contenido, enlaces internos y datos estructurados que tu versión de escritorio? Cualquier cosa oculta en móvil «porque no cabe» (tras un «leer más» que no carga) es invisible para Google.

-

Usabilidad: Revisa el informe de GSC.

-

Pruebas Reales: Usa la emulación de Chrome DevTools, pero también prueba en un dispositivo real de gama media.

-

6.2. SEO Internacional (hreflang)

Si tienes múltiples idiomas o versiones regionales.

-

Auditoría:

hreflanges la parte más fácil de estropear.-

Errores Comunes: ¿Usas

en-UKen lugar deen-GB? ¿Usases-LAen lugar dees-419? -

Bidireccionalidad: El error nº1. Si la Página A (en inglés) enlaza a la Página B (en español) como su alternativa, la Página B debe enlazar de vuelta a la Página A como su alternativa. Si falta este retorno, toda la implementación se ignora.

-

x-default: ¿Tienes una etiquetahreflang="x-default"que apunte a una página de selección de idioma o a tu versión «global» (generalmente en inglés)?

-

La Checklist Definitiva de Auditoría SEO Técnica (2025)

Usa esto como tu hoja de ruta.

Fase 1: Rastreo e Indexación

-

[ ]

robots.txtno bloquea recursos críticos (JS/CSS). -

[ ]

robots.txtbloquea URLs de parámetros/filtros que gastan presupuesto. -

[ ]

robots.txtdeclara la política paraGoogle-Extended(IA). -

[ ]

robots.txtenlaza al sitemap XML. -

[ ] No hay conflictos de

noindexen páginas rastreables. -

[ ]

X-Robots-Tagse usa para PDFs y archivos no-HTML. -

[ ]

indexifembeddedse usa correctamente para contenido incrustado. -

[ ] Sitemap XML está limpio, actualizado y solo contiene URLs 200.

-

[ ] Sitemap XML usa

correctamente. -

[ ] El sitio usa sitemaps de Imágenes/Vídeo si es relevante.

-

[ ] (Avanzado) Análisis de Logs: Frecuencia de rastreo de Googlebot es alta en páginas «money».

-

[ ] (Avanzado) Análisis de Logs: Googlebot no recibe un exceso de errores 4xx/5xx.

-

[ ] Sitio usa SSR, SSG o Dynamic Rendering para contenido JS-dependiente.

-

[ ] Los enlaces internos son

y no JSonClick.

Fase 2: Core Web Vitals y Rendimiento

-

[ ] GSC no reporta URLs «Pobres» para INP.

-

[ ] (Avanzado) INP: Tareas de JS en el hilo principal están optimizadas (<50ms).

-

[ ] GSC no reporta URLs «Pobres» para LCP.

-

[ ] Elemento LCP está pre-cargado (

). -

[ ] Imágenes LCP están en formato

WebP/AVIFy comprimidas. -

[ ] GSC no reporta URLs «Pobres» para CLS.

-

[ ] Imágenes, vídeos e iframes tienen

aspect-ratioo dimensiones definidas. -

[ ] Espacio reservado para anuncios y contenido dinámico.

-

[ ] Fuentes web usan

font-display:.

swap;

Fase 3: Arquitectura y Enlazado

-

[ ] Páginas «Money» están a < 3 clics de la Home.

-

[ ] No hay enlaces internos rotos (404).

-

[ ] No se usan 302 (temporales) para redirecciones permanentes.

-

[ ] No existen cadenas de redirección (A > B > C).

-

[ ] Todas las páginas tienen una

rel="canonical"auto-referenciada. -

[ ] URLs con parámetros tienen una canonical a la URL limpia.

-

[ ] La paginación está gestionada con enlaces

y no genera duplicados.

Fase 4: Seguridad y Confianza

-

[ ] Todo el sitio se sirve bajo HTTPS.

-

[ ] No hay «Mixed Content» (recursos HTTP en páginas HTTPS).

-

[ ] (Avanzado) HSTS está implementado en las cabeceras del servidor.

-

[ ] (Avanzado) CSP está implementado para prevenir XSS.

-

[ ] CMS y plugins están 100% actualizados.

Fase 5: Datos Estructurados (Schema)

-

[ ] Schema implementado vía JSON-LD.

-

[ ] Schema valida sin errores en el «Rich Results Test».

-

[ ] Se usa Schema relevante (

Article,Product,FAQPage,Organization). -

[ ] (Avanzado) Schema está anidado para crear un grafo de conocimiento.

Fase 6: Móvil e Internacional

-

[ ] Paridad 100% de contenido, enlaces y Schema entre móvil y escritorio.

-

[ ] El informe de «Usabilidad Móvil» de GSC está limpio.

-

[ ] (Avanzado)

hreflang: Los enlaces son bidireccionales. -

[ ] (Avanzado)

hreflang: Se usa la etiquetax-default.

Conclusión: La Auditoría es el Mapa, no el Destino

Completar esta auditoría de más de 60 puntos avanzados te dará algo más que una lista de errores. Te dará un mapa de ruta priorizado.

La auditoría SEO técnica en 2025 es el trabajo de un arquitecto digital. Asegura que la estructura no solo sea sólida (seguridad), sino que sea fácil de navegar (arquitectura), que los ascensores sean rápidos (CWVs) y que las señalizaciones estén en un idioma que tanto los humanos como la IA puedan entender (Schema).

Empieza por la Fase 1. Arregla lo que está roto. Luego, pasa a optimizar lo que funciona. Y nunca dejes de medir.

Preguntas y Respuestas (FAQ)

1. ¿Cuál es la principal diferencia entre una auditoría SEO técnica en 2025 y una de hace tres años?

1. ¿Cuál es la principal diferencia entre una auditoría SEO técnica en 2025 y una de hace tres años?

La diferencia fundamental radica en dos ejes: IA y Reactividad. Hace tres años, el foco estaba en la «cargabilidad» (medida por LCP y FID) y la «rastreabilidad» básica. En 2025, el foco es:

-

Contextualización para IA: Ya no basta con ser indexado. Tu contenido debe estar semánticamente estructurado con Schema.org para que las IAs generativas (AI Overviews) puedan entenderlo, confiar en él y usarlo para responder consultas. Auditamos la riqueza y precisión de JSON-LD.

-

Reactividad Total (INP): El cambio de FID a INP (Interaction to Next Paint) es masivo. FID solo medía el retraso de la primera interacción. INP mide la latencia de todas las interacciones durante la vida de la página. Esto obliga a auditar la eficiencia de todo el JavaScript, no solo el de la carga inicial.

2. ¿Cómo audito mi sitio específicamente para los "AI Overviews" (antes SGE)?

2. ¿Cómo audito mi sitio específicamente para los "AI Overviews" (antes SGE)?

Auditar para IA es auditar la claridad y la autoridad.

-

Riqueza de Schema: ¿Estás usando Schemas anidados que expliquen claramente quién eres (

Organization), quién escribió el contenido (Person), qué es (Article,Product), y qué responde (FAQPage,HowTo)? La IA usa esto como fuente de verdad. -

Contenido Citable: ¿Tu contenido responde preguntas de forma directa y concisa? La IA busca «fragmentos» de respuesta que pueda citar.

-

Rastreador de IA: Revisa tus logs para el user-agent

Google-Extended. ¿Está rastreando tu sitio? Si lo bloqueaste enrobots.txt, estás excluido de que tu contenido entrene a los modelos futuros, lo cual puede (o no) ser tu estrategia. -

E-E-A-T: La IA prioriza contenido de fuentes con alta experiencia, autoridad y confianza. Tu auditoría técnica (seguridad, velocidad, enlaces de autoridad) es la base de ese E-E-A-T.

3. Mi informe de GSC dice que tengo un INP "Pobre". ¿Cuáles son los pasos técnicos para solucionarlo?

3. Mi informe de GSC dice que tengo un INP "Pobre". ¿Cuáles son los pasos técnicos para solucionarlo?

Un INP pobre casi siempre es un hilo principal (main thread) bloqueado por JavaScript.

-

Identifica al Culpable: Usa Chrome DevTools > «Performance». Graba un perfil, haz clic en los elementos lentos (menús, formularios) y mira la «Main Thread». Verás tareas largas de JS (bloques rojos).

-

Divide y Vencerás: Ninguna tarea de JS debería durar más de 50ms. Si tienes una tarea de 200ms, divídela en cuatro tareas de 50ms usando

setTimeouto, mejor aún, la APIscheduler.postTask(). Esto permite al navegador «respirar» y responder a otras interacciones entre tareas. -

Delega a Web Workers: Si estás haciendo cálculos pesados que no necesitan acceso al DOM (ej. procesar datos, filtrar una lista grande), muévelos a un «Web Worker». Este se ejecuta en un hilo separado y no bloquea la interfaz de usuario.

-

Optimiza Event Listeners: ¿Tienes un

scrollomousemovelistener muy pesado? Optimízalo (usa «debounce» o «throttle») para que no se dispare mil veces por segundo.

4. ¿Es realmente necesario el Análisis de Logs para un sitio pequeño o mediano?

4. ¿Es realmente necesario el Análisis de Logs para un sitio pequeño o mediano?

Respuesta honesta: No siempre, pero es donde se encuentran los problemas «fantasma». Para un blog de 500 páginas, GSC es suficiente. Pero si eres un e-commerce de 50.000 productos o un sitio de noticias, es crítico. GSC te da una muestra (sampling) de lo que Google ve. Los logs te dan el 100% de la verdad. El análisis de logs te dirá si Googlebot está:

-

Ignorando tus nuevas categorías de productos.

-

Pasando el 80% de su tiempo en URLs de búsqueda facetada (ej.

?color=rojo&talla=m&pagina=3). -

Recibiendo errores 503 (Servidor Ocupado) a las 3 AM. Son problemas que GSC reportará de forma vaga, pero que los logs identifican al instante.

5. Mi sitio está hecho 100% en un framework de JS (React, Vue). ¿Cuál es la mejor configuración de renderizado para el SEO en 2025?

5. Mi sitio está hecho 100% en un framework de JS (React, Vue). ¿Cuál es la mejor configuración de renderizado para el SEO en 2025?

Google ha mejorado mucho en el renderizado de JavaScript del lado del cliente (CSR), pero sigue siendo la opción menos eficiente para el rastreador.

-

Ideal (Oro): Server-Side Rendering (SSR) o Static Site Generation (SSG).

-

SSG (ej. Next.js, Nuxt): La página se genera como un HTML estático en el momento de la compilación (build). Es lo más rápido y eficiente para el SEO. Ideal para blogs, sitios de contenido.

-

SSR (ej. Next.js, Nuxt): La página se genera en el servidor en cada solicitud. Sigue siendo HTML puro para Google. Ideal para contenido muy dinámico (e-commerce, perfiles de usuario).

-

-

Bueno (Plata): Dynamic Rendering. Es un «parche». Tu servidor detecta el user-agent. Si es un usuario, le sirve la app JS. Si es Googlebot, le sirve una versión HTML pre-renderizada (usando un servicio como Rendertron). Funciona, pero es complejo de mantener.

-

Mínimo (Bronce): Client-Side Rendering (CSR). Confías en que Google renderice el JS. Funciona, pero prepárate para retrasos en la indexación y posibles errores si tu JS es muy pesado o falla.

6. ¿Qué es una "Crawl Trap" (Trampa de Rastreo) y cómo la encuentro y soluciono?

6. ¿Qué es una "Crawl Trap" (Trampa de Rastreo) y cómo la encuentro y soluciono?

Una «Crawl Trap» es un bucle infinito que atrapa a un rastreador, haciéndole gastar todo su presupuesto en URLs inútiles.

-

Ejemplo Clásico: Un calendario. Google rastrea «hoy», luego «siguiente día», «siguiente día», «siguiente día»… y acaba en el año 3050.

-

Ejemplo Moderno: Navegación facetada en e-commerce.

/zapatos?color=rojo, luego/zapatos?color=rojo&talla=42, luego/zapatos?color=rojo&talla=42&marca=x… Las combinaciones son infinitas. -

Cómo Encontrarlas: Usa Screaming Frog. Si tu rastreo de 5.000 URLs se convierte en 5.000.000, tienes una trampa. También lo verás en los logs (Googlebot rastreando miles de URLs con patrones de parámetros).

-

Cómo Solucionarlas:

-

robots.txt: Bloquea el patrón de parámetro (Disallow:).

/*?talla= -

rel="canonical": Asegúrate de que todas las URLs facetadas apunten canónicamente a la URL de la categoría principal. -

nofollow: Aplicarel="nofollow"a los enlaces que generan estas trampas (ej. el enlace de «siguiente día» en un calendario).

-

7. Mi sitio es internacional. ¿Cuál es el error más grave que se puede cometer con hreflang?

7. Mi sitio es internacional. ¿Cuál es el error más grave que se puede cometer con hreflang?

El error más grave y común es la falta de enlaces bidireccionales (de retorno). hreflang funciona como un pacto de confianza. Si tu página en español (es-es) dice que su versión en inglés es la página B (en-gb), Google va a la página B para confirmarlo. Si la página B no tiene una etiqueta hreflang que apunte de vuelta a la página A (es-es), Google considera que la conexión está rota e ignora toda la implementación. El segundo peor error es usar códigos incorrectos, como en-UK (Reino Unido) en lugar del código ISO correcto en-GB.

8. ¿Qué es una Content Security Policy (CSP) y por qué le importa al SEO?

8. ¿Qué es una Content Security Policy (CSP) y por qué le importa al SEO?

Una CSP es una cabecera de seguridad HTTP que le dice al navegador qué dominios tienen permiso para ejecutar scripts, cargar estilos, imágenes, etc., en tu página.

-

Por qué importa al SEO: Su función principal es bloquear ataques de Cross-Site Scripting (XSS). Un ataque XSS es una de las formas más comunes en que un sitio es hackeado para SEO. El atacante inyecta su propio script, que luego puede añadir enlaces de spam, redirigir a los usuarios a sitios maliciosos o mostrar contenido de spam.

-

Si Google detecta esto, tu sitio será marcado como «hackeado» o «engañoso», tu ranking se desplomará y serás penalizado. Una CSP robusta es una defensa técnica proactiva que protege tu E-E-A-T (Confianza).

9. ¿Sigue siendo relevante la optimización del "Crawl Budget" (Presupuesto de Rastreo) en 2025?

9. ¿Sigue siendo relevante la optimización del "Crawl Budget" (Presupuesto de Rastreo) en 2025?

Más que nunca, pero el concepto ha evolucionado. Ya no se trata solo de «ser rastreado para indexar». Se trata de eficiencia y frescura. Google tiene recursos finitos. ¿Prefieres que Googlebot pase su tiempo rastreando 10.000 URLs de parámetros sin valor o que vuelva a rastrear 5 veces al día tu artículo principal porque lo has actualizado? Optimizar el presupuesto de rastreo (bloqueando basura, arreglando 404, usando sitemaps y lastmod) asegura que Google dedique sus recursos a tu contenido más importante, descubra tus actualizaciones más rápido y mantenga tu índice «fresco».

10. Más allá de GSC y Screaming Frog, ¿cuál es la herramienta o técnica más avanzada para una auditoría técnica?

10. Más allá de GSC y Screaming Frog, ¿cuál es la herramienta o técnica más avanzada para una auditoría técnica?

El Panel «Performance» de Chrome DevTools. Mientras que PageSpeed Insights te da una puntuación, el panel «Performance» te da el video forense de por qué es lenta. Te permite grabar la carga de la página y ver un «flame chart» (gráfico de llama) que muestra cada milisegundo:

-

Cuándo se ejecuta cada script de JS.

-

Cuánto tarda el navegador en «parsear» el HTML.

-

Cuánto tiempo se dedica al «Layout» y al «Painting» (culpables de CLS e INP).

-

Qué tarea específica de JS está bloqueando el hilo principal (el culpable de INP). Es la herramienta definitiva para diagnosticar cuellos de botella de rendimiento que ninguna otra herramienta automatizada puede identificar con tanta precisión.